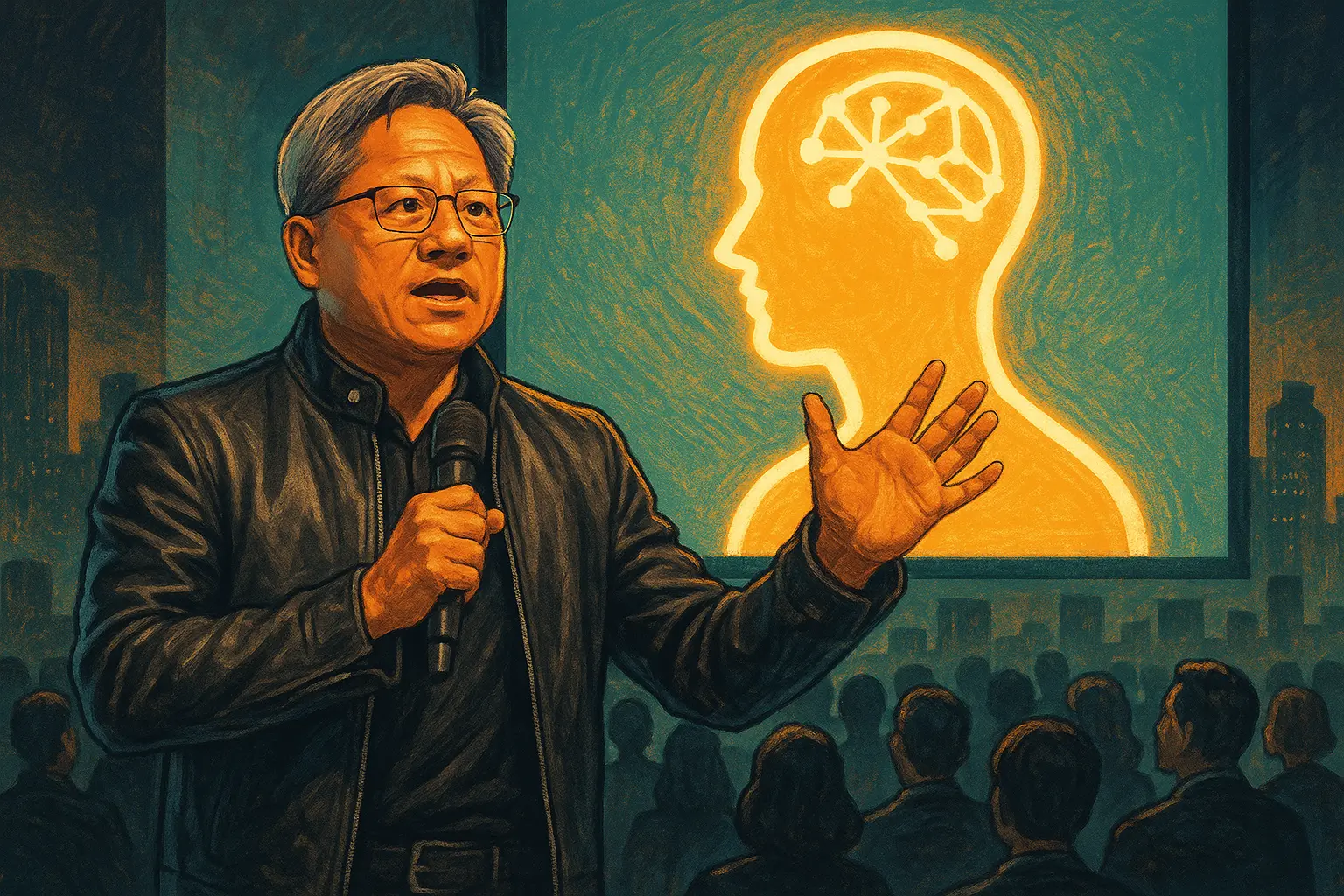

Déclaration d'AGI de Huang Ren-Hsuan choque l'industrie technologique, si elle est vérifiée, remodelera le paysage commercial mondial

Le PDG de Nvidia, Jensen Huang, a récemment déclaré publiquement « avoir réalisé une intelligence artificielle générale (AGI) », ajoutant que la gestion autonome d’une entreprise par un système d’IA ou la publication d’applications à faible coût destinées à des milliards d’utilisateurs « n’est pas impossible ». C’est l’une des déclarations publiques les plus fortes à ce jour concernant l’existence de l’AGI. Cependant, la communauté scientifique manque encore d’une définition reconnue de l’AGI, et aucun organisme scientifique ou réglementaire majeur n’a confirmé son arrivée.

Qu’est-ce que l’AGI selon Jensen Huang ?

(Source : X)

(Source : X)

L’intelligence artificielle générale (AGI) désigne une IA capable d’apprendre, de raisonner et de s’adapter dans tous les domaines, comme un humain, contrairement aux systèmes étroits actuels qui excellent dans des tâches spécifiques comme l’écriture ou la programmation. Contrairement à l’IA qui nécessite la création de modèles séparés pour chaque tâche, l’AGI devrait théoriquement être capable de fonctionner de manière générale à travers différents domaines, sans entraînement spécifique pour chaque tâche.

Jensen Huang illustre son point de vue en donnant l’exemple d’une IA capable de construire et d’étendre de manière autonome des services en ligne destinés à des milliards d’utilisateurs, avec peu d’intervention humaine pour la planification, l’exécution et l’itération. Si cette capacité existe réellement, cela marquerait une transition de l’IA d’un simple outil d’assistance à un système doté d’une capacité d’autonomie — c’est la caractéristique centrale de l’AGI qu’il décrit, et ce qui rend cette déclaration si remarquée.

Réserves de la communauté scientifique : pourquoi les chercheurs ne reconnaissent pas encore que l’« AGI est réalisée »

Principales critiques des chercheurs mainstream

Absence de définition reconnue : Il n’existe pas de définition universellement acceptée de l’AGI, chaque institution et chercheur ayant ses propres critères pour ce qui est « général », rendant toute affirmation d’« accomplissement » difficile à vérifier objectivement.

Fiabilité limitée : Les IA actuelles font fréquemment des erreurs dans des scénarios peu courants, et leur capacité à raisonner avec des connaissances générales du monde réel reste faible — une compétence fondamentale pour l’AGI.

Stabilité à long terme : La plupart des systèmes actuels peinent à exécuter des tâches impliquant plusieurs étapes ou sur de longues périodes, ce qui est pourtant une exigence clé pour l’AGI.

Absence de certification officielle : À ce jour, aucun organisme scientifique, organisation de sécurité de l’IA ou autorité réglementaire n’a officiellement confirmé que l’AGI a été atteinte.

Si l’AGI est effectivement réalisée : impacts potentiels sur le commerce, les logiciels et la géopolitique mondiale

La déclaration de Jensen Huang, bien qu’elle fasse débat, ouvre des perspectives aux implications profondes. Si l’IA atteint réellement le niveau d’AGI qu’il décrit, l’impact dépasserait largement la technologie elle-même : la capacité à planifier et à étendre des services logiciels à grande échelle pourrait réduire drastiquement les coûts de développement logiciel ; une IA capable de gérer des entreprises pourrait transformer la structure organisationnelle des sociétés ; la diffusion d’applications à très faible coût pour des milliards d’utilisateurs pourrait bouleverser le monopole actuel des grandes plateformes technologiques.

Actuellement, la déclaration de Huang ravive le débat : l’IA a-t-elle franchi cette étape historique ou s’en approche-t-elle seulement ? La direction de cette discussion aura des répercussions profondes pour Nvidia, l’ensemble de l’industrie de l’IA, et même pour le cadre réglementaire mondial.