2028年にAIは世界経済を崩壊させるのか?「2028年グローバル・インテリジェンス危機」レポートの詳細分析とAI終末論の現実性

「2028年グローバル知能危機」レポートの本質とは何か?

近年、市場ではCitrini Research創設者James van Geelen氏とAlap Shah氏が共同執筆した「2028年グローバル知能危機」レポートが注目を集めています。レポートは2028年6月の“未来の視点”から過去数年を振り返り、AIが急速に多くのホワイトカラー職を代替するシナリオを描写。この結果、消費需要の崩壊、企業利益の縮小、資産価格の暴落、そして最終的には世界規模のシステミック経済危機に至る流れを示しています。

著者らは、これはあくまで「シナリオ分析」であり、予測ではないと強調しています。しかし、劇的なストーリーとAIの急速な進展が重なり、「AI終末論」的な論調が拡大。テック株や雇用見通しに対する投資家の不安を煽っています。

一部の経済学者は、これを「ストレステスト」としての思考実験と捉え、AIの代替速度や政策対応の遅れに関する前提が極端で、システミックな崩壊確率を過大評価していると指摘します。投資家の中にはAIの生産性向上による破壊的影響への警鐘と見る向きもあります。実際、レポートはテック株のボラティリティを誘発しましたが、多くのトレーダーはこれをファンダメンタルズではなく市場心理の影響と分析しています。総じて、主流の見解は「AI終末論」シナリオを否定しつつも、AIの進展が社会の適応力を上回れば構造的ショックが発生しうると認識しています。

ここで本質的な問いが生まれます。本当にこのシナリオは2028年に実現するのでしょうか?

なぜ「AI終末論」ナラティブは市場にパニックを引き起こすのか?

「AI終末論」的な主張が市場心理に響くのは、現在の3つの不安に根ざしています:

- AIが高所得の知識労働を代替している

- 企業が自動化ツールを大規模導入している

- 生産性向上が労働需要を抑制する可能性がある

過去の産業自動化の波と異なり、今回のAIは主に分析・執筆・プログラミング・カスタマーサービス・金融リサーチなど認知的職種を直接脅かしています。これはブルーカラーだけではなく、中間層の雇用の安定にも直結する問題です。

雇用や所得への期待が揺らぐと、資本市場は本能的に先回りして反応します。

ただし、センチメントと実体経済にはしばしばタイムラグや規模の差があります。

AIの成熟度:2028年に本当に世界経済の混乱は起こるのか?

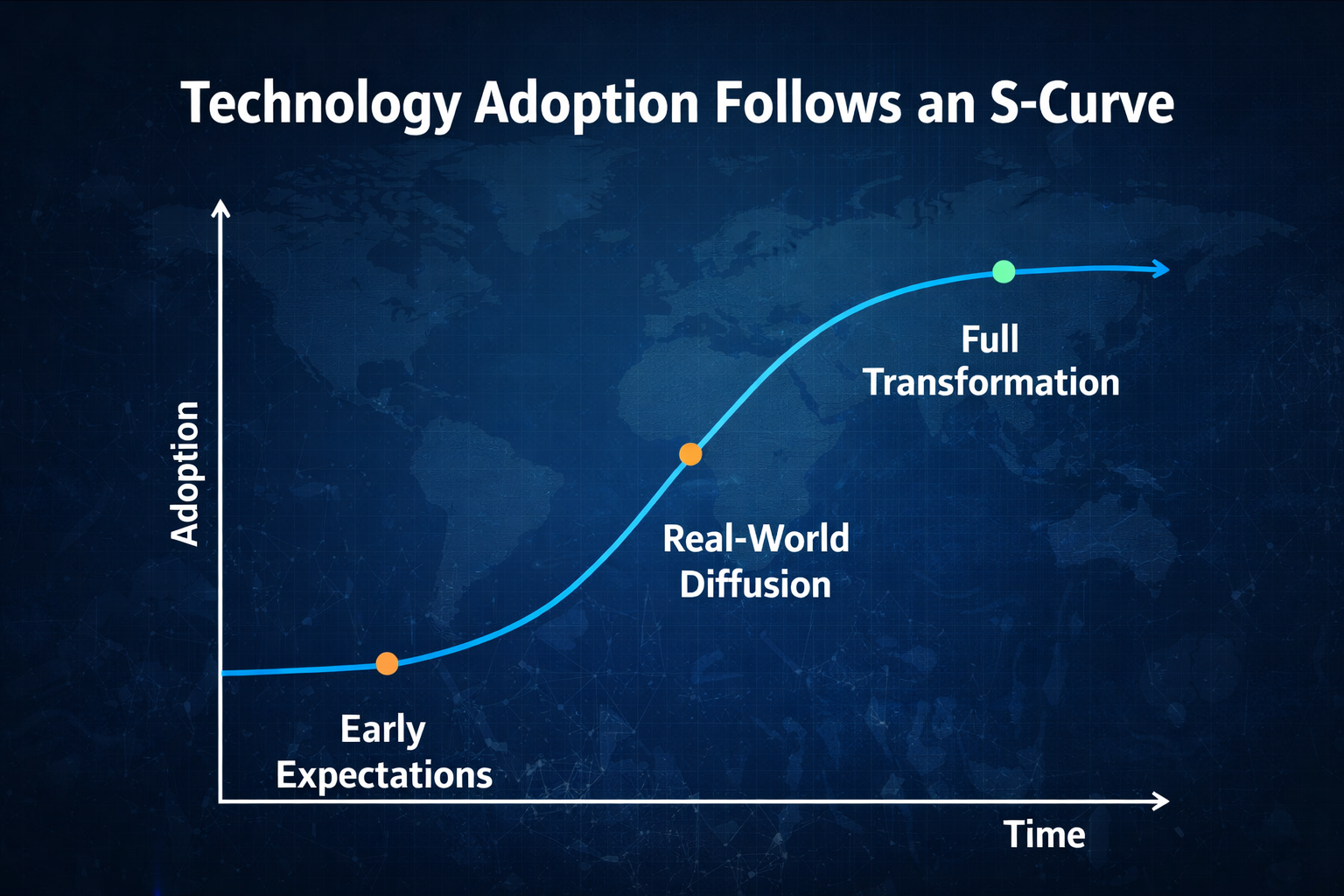

システミック崩壊リスクの評価は、技術普及のスピードから始まります。

歴史的に技術普及はSカーブを描きます:

- 初期段階の高い期待

- 中盤の導入と調整

- 後期の大規模展開

AI能力が進化し続けても、企業は以下のプロセスが不可欠です:

- ITシステムの再構築

- データガバナンス

- コンプライアンス審査

- 組織プロセスの再設計

これらには一定の時間が必要です。2028年までの期間は短く、マクロ的に見てグローバル企業がその時点で完全な人員代替を達成する確率は低いでしょう。現実的なのは「局所的な高効率化と段階的な代替」です。

技術進歩が急速でも、経済構造の変化は緩やかです。

ホワイトカラー大量失業の波は現実化するのか?

レポートの核心的な連鎖は次の通りです:

AIによる代替 → ホワイトカラー大量失業 → 消費崩壊 → 信用危機 → 金融システム動揺

実際には、企業の調整は通常段階的に進みます:

- 採用凍結

- 自然減

- 部門統合

- 選択的なレイオフ

全職種の一括・全面的な代替はほぼありません。

また、新技術は新たな職種を生み出す傾向があります:

- AI管理・最適化

- データガバナンス

- アルゴリズムセキュリティ

- 人機協働設計

本質的なリスクは「中間スキルの圧縮」であり、失業の大量発生ではありません。

したがって2028年には、雇用構造の二極化が進むものの、全面的な崩壊には至らないでしょう。

AIはシステミック金融危機を引き起こし得るのか?

システミックな金融危機には一般的に以下2つが不可欠です:

- 高レバレッジ

- バランスシートの連鎖的破綻

2008年は信用システムの内部崩壊、2020年は外部ショックでした。AIショックは、銀行資産の直接毀損よりも「利益構造の再編イベント」となる可能性が高いです。

また、現在のマクロシステムには以下が組み込まれています:

- 自動安定化装置(失業保険)

- 中央銀行の迅速な利下げ手段

- 財政刺激策の実行力

雇用への圧力が高まっても、政策当局は迅速な介入が可能です。AIが即座にグローバル信用システムを崩壊させるリスクは低いでしょう。

より現実的な2028年シナリオは?

技術普及とマクロ経済の伝播パターンを踏まえると、2028年に最も起こりうるのは「グローバルなシステミック経済崩壊」ではなく、緩やかで深い構造的転換です。

1.テック業界の利益率が一時的に上昇する可能性。AIの広範な導入で限界コストが大幅に削減され、とりわけソフトウェア開発・カスタマーサービス・データ分析・コンテンツ制作で顕著です。データ・計算力・モデルで優位な企業は規模・ネットワーク効果を強化し、利益が上位に集中します。この「効率配当」により、テック業界全体の収益性が一時的に高まる可能性があります。

2.一部ホワイトカラー職は縮小するが消滅しない。全面的な代替よりも機能再編が進みやすいです。反復的・プロセス型・標準化された知識労働が先に影響を受け、複雑な意思決定・対人・創造的な職種は価値を維持します。雇用市場ではスキルの階層化が進み、AIとの協働に長けた人材は所得増、そうでない層は圧力を受けます。

3.所得格差の拡大が現実的なリスク。AIによる生産性配当はまず資本・テックプラットフォーム・高度人材に流れ、中間層の知識労働者は交渉力を失います。この不均衡な分配が消費や社会心理、政策再分配圧力の変化をもたらす可能性があります。

4.市場のボラティリティが急上昇する。生産性期待が急速に織り込まれると、資本市場ではバリュエーションの大きなサイクルが生じます。AI関連株は高い期待で急騰する一方、利益が追いつかなければボラティリティが急増します。

5.資本はAIインフラにさらに集中する可能性。計算力・半導体・データセンター・エネルギー・クラウドプラットフォームは長期的な恩恵を受けます。アプリケーション層と比べ、基盤リソースは代替困難かつ価格決定力が高く、「計算力とエネルギー」への投資が加速します。

AIの最も現実的な帰結は「構造的ショック」であり、「システミックな破壊」ではありません。経済システムは崩壊せず、資源配分が根本的に変わるでしょう。

リスクの中心は以下に集約されます:

- 資産バブル

- 過大評価

- レバレッジ

仮に危機が起きるとしても、それはAIナラティブ・バブルの崩壊であり、AIそのものが経済を破壊するわけではありません。

投資家はAIリスクと機会にどう向き合うべきか?

投資の観点から重要なのは3つのリスク領域です。

AI投資で問われるのは「AIを信じるか否か」ではなく、リスクの所在です。リスクは以下3種類に分類されます:

1. 技術リスク:モデル進化の停滞、計算コストの上昇、規制強化による導入制限。進展が市場期待に届かなければ、高いバリュエーションは調整リスクを抱えます。

2. ナラティブリスク:市場はしばしば10年分の生産性向上を先取りします。利益実現が遅れれば、バリュエーションは急速に圧縮されます。多くの技術革命は「ナラティブ過熱→利益検証→バリュエーション平均回帰」を繰り返してきました。

3. 構造リスク:短期的にAIが中間層職を圧縮し、所得が資本側にシフトすれば、消費需要が弱まり一部セクターの成長に影響します。

長期的にはAIが生産性を押し上げるものの、短期的なボラティリティは避けられません。合理的な戦略例:

単一セクターへの集中リスクを避ける分散投資

キャッシュフローの質に注目し、収益力の高い企業を選択

高レバレッジを避け、変動期の損失を限定

政策動向を注視し、規制や財政政策の変化による業界トレンドの変化を監視

本質的なリスクは技術そのものではなく、市場の評価の仕方にあります。

結論:AIは2028年に世界経済崩壊をもたらすのか?

技術普及の速度、企業変革サイクル、マクロ政策の対応力、金融システムの安定性を総合的に考慮すると、グローバルなシステミック崩壊の可能性は低いでしょう。しかし、雇用構造のショックや市場のボラティリティ上昇リスクは依然として高い水準です。「2028年グローバル知能危機」はマクロストレステストとして捉え、AIの代替スピードと社会の適応力のギャップに注目すべきです。

AIは終末装置ではなく「増幅器」です。効率を高める一方で、不均衡も拡大します。2028年を本当に形作るのは、技術力だけでなく、政策対応・社会の適応力・資本市場の合理性です。

パニックよりも合理性が重要です。

関連記事

Falcon FinanceとEthena:合成ステーブルコイン市場の徹底比較

Falcon Financeトークノミクス:FFバリューキャプチャの解説

Plasma(XPL)トークノミクス分析:供給、分配、価値捕捉

Raydiumの利用方法:初心者のための取引と流動性提供ガイド

Raydiumのコア機能とは?取引および流動性プロダクトを徹底解説