Cơ sở hạ tầng AI đã bước sang giai đoạn thứ hai, từ chip và HBM đến suy luận và năng lượng, các yếu tố này sẽ trở thành động lực tăng trưởng chủ chốt trong 2 – 3 năm tới

Vì sao chip và HBM trở thành điểm nóng ban đầu

Nhìn lại làn sóng AI hiện tại, các lĩnh vực thu hút định giá tập trung trên thị trường vốn đều xoay quanh chip và bộ nhớ. Lý do rất rõ ràng: việc cải tiến nhanh của các mô hình lớn phụ thuộc vào khả năng đào tạo quy mô lớn, và yếu tố trực tiếp hạn chế năng lực đào tạo chính là nguồn cung sức mạnh tính toán cao cấp. Số lượng GPU càng nhiều, cơ hội đào tạo mô hình lớn hơn, cung cấp dịch vụ đám mây mạnh hơn và xây dựng hệ sinh thái vững chắc càng lớn.

Tuy nhiên, khi sức mạnh tính toán của từng chip tăng lên, các điểm nghẽn mới xuất hiện nhanh chóng. Hệ thống AI không chỉ cần “tính toán nhanh” mà còn phải được “cung cấp đủ dữ liệu”. Điều này đã nâng tầm chiến lược của bộ nhớ băng thông cao (HBM) một cách nhanh chóng. Đối với đào tạo mô hình lớn và suy luận mật độ cao, băng thông bộ nhớ không còn là vấn đề phụ — mà đã trở thành biến số cốt lõi tác động trực tiếp đến thông lượng, độ trễ và hiệu suất năng lượng.

Các báo cáo công khai gần đây càng củng cố lập luận này. Theo Reuters, ban lãnh đạo SK Group cho biết tình trạng thiếu wafer trên toàn cầu có thể kéo dài đến năm 2030, và SK Hynix dự báo nhu cầu HBM sẽ vượt cung trong nhiều năm tới. Điều này cho thấy việc thị trường tập trung vào chip và HBM không chỉ là do tâm lý — AI đang tái cấu trúc căn bản động lực cung cầu của bán dẫn cao cấp.

Có ba lý do chính khiến chip và HBM trở thành điểm nóng ban đầu:

-

Điểm nghẽn rõ ràng nhất: Trong giai đoạn đào tạo, khoảng cách về sức mạnh tính toán dễ dàng định lượng và dễ nhận thấy nhất đối với ngành và thị trường vốn.

-

Mở rộng nguồn cung chậm nhất: Logic cao cấp, đóng gói nâng cao và HBM đều là các phân khúc có rào cản cao, chu kỳ mở rộng dài, yêu cầu chứng nhận nghiêm ngặt và khó thay thế.

-

Truyền dẫn giá trực tiếp nhất: Khi thiếu nguồn cung kéo dài, sự thay đổi về đơn hàng, giá cả và lợi nhuận sẽ được phản ánh rõ rệt vào kết quả kinh doanh của doanh nghiệp.

Theo đó, chip, HBM và đóng gói nâng cao tiếp tục tăng nhiệt trong thời gian gần đây, phù hợp với cả nền tảng ngành và sở thích thị trường.

Vì sao hạ tầng AI chuyển dịch từ đào tạo sang suy luận

Dù chip và HBM vẫn đóng vai trò quan trọng, trọng tâm của hạ tầng AI đã bắt đầu thay đổi. Trước đây, ngành tập trung chủ yếu vào đào tạo mô hình; hiện nay, nhiều nguồn lực đang được chuyển sang triển khai suy luận và vận hành ở cấp độ sản xuất.

Lý do rất rõ ràng: đào tạo xác định giới hạn trên của năng lực mô hình, còn suy luận quyết định quy mô thương mại hóa. Đào tạo là hoạt động đầu tư lớn chỉ dành cho một số doanh nghiệp dẫn đầu, còn suy luận diễn ra mỗi khi có người dùng thực gọi mô hình. Các kịch bản như tìm kiếm, làm việc văn phòng, CSKH, quảng cáo, tạo mã, tạo video, hỏi đáp cơ sở tri thức doanh nghiệp và tự động hóa Agent đều phụ thuộc vào các yêu cầu suy luận liên tục.

Theo Báo cáo Chiến lược Ứng dụng Doanh nghiệp năm 2026 của F5, 78% doanh nghiệp đã vận hành suy luận AI như một năng lực cốt lõi, và 77% cho rằng suy luận — chứ không phải đào tạo — mới là kịch bản hoạt động chính của AI. Dữ liệu này gửi đi tín hiệu mạnh mẽ: AI đang chuyển từ phòng thí nghiệm sang hệ thống sản xuất, và nhu cầu chuyển từ “cạnh tranh năng lực mô hình” sang “cạnh tranh hiệu quả vận hành”.

Khi AI đi vào quy trình thực tế, mối quan tâm chính của doanh nghiệp chuyển từ số lượng tham số mô hình sang các chỉ số vận hành như:

- Độ trễ có ổn định không?

- Chi phí có kiểm soát được không?

- Có thể chuyển đổi giữa nhiều mô hình không?

- Dữ liệu có an toàn không?

- Kết quả có thể kiểm toán không?

- Hệ thống có tích hợp được với nền tảng kinh doanh hiện tại không?

Điều này có nghĩa là hạ tầng AI đang phát triển từ các cụm đào tạo đơn lẻ sang hệ thống vận hành suy luận phức tạp hơn, gồm:

- Nền tảng dịch vụ mô hình

- Khung tăng tốc suy luận

- Lập lịch và định tuyến đa mô hình

- Truy xuất vector và quản lý ngữ cảnh

- Hệ thống điều phối Agent

- Kiểm toán bảo mật và kiểm soát truy cập

Sự chuyển dịch này cũng thể hiện rõ trong chiến lược của các nhà cung cấp phần cứng. Trong bản phát hành công khai năm 2026, Google Cloud nhấn mạnh các sản phẩm TPU tối ưu cho suy luận, nổi bật với độ trễ thấp, ngữ cảnh dài và khả năng đồng thời Agent quy mô lớn. Bản thân kiến trúc phần cứng cũng chuyển từ ưu tiên “đào tạo trước” sang “suy luận trước”.

Vì sao điểm nghẽn thực sự đã mở rộng sang trung tâm dữ liệu và năng lượng

Nếu mối quan tâm chính ở giai đoạn trước là “Có GPU không?”, thì câu hỏi cấp thiết hiện nay là “Sau khi có GPU, có thể triển khai ổn định không?”

Đây là giai đoạn thứ hai của hạ tầng AI. GPU vẫn là tài sản cốt lõi, nhưng chỉ khi kết hợp với trung tâm dữ liệu, nguồn điện, hệ thống làm mát, mạng lưới, chuyển mạch và vận hành thì mới biến thành năng suất thực sự. Nói cách khác, điểm nghẽn của ngành AI đã chuyển từ phần cứng đơn lẻ sang năng lực toàn hệ thống.

Một số diễn biến công khai gần đây làm nổi bật xu hướng này:

- Các tập đoàn công nghệ hàng đầu Bắc Mỹ sẽ tiếp tục tăng chi tiêu vốn liên quan đến AI trong năm 2026, đầu tư không chỉ vào chip mà còn vào khu trung tâm dữ liệu, kiến trúc mạng và mở rộng hạ tầng.

- Dự báo công khai của ngành năng lượng Mỹ cho thấy mức tiêu thụ điện sẽ đạt mức cao mới trong năm 2026 và 2027, với trung tâm dữ liệu và AI là động lực chính.

- Nhiều dự án trung tâm dữ liệu AI quy mô lớn hiện tập trung vào nguồn cung hàng trăm megawatt, hợp đồng thuê dài hạn và phát triển khuôn viên, cho thấy ngành đã chuyển trọng tâm sang “làm thế nào để hỗ trợ sức mạnh tính toán”.

Điều này có nghĩa ngành AI ngày càng giống hệ thống công nghiệp nặng, không còn là mở rộng tài sản nhẹ kiểu thời kỳ internet. Biến số then chốt cho mở rộng tương lai chuyển từ “có thể thiết kế chip mạnh hơn không” sang “có thể nhanh chóng đảm bảo nguồn điện, đất đai, làm mát và mạng lưới không”.

Từ góc nhìn ngành, sự chuyển đổi này mang lại ít nhất bốn hệ quả:

-

Trung tâm dữ liệu chuyển từ tài sản CNTT sang tài sản chiến lược: Khối lượng AI mật độ cao đòi hỏi tiêu chuẩn mới hoàn toàn về cơ sở vật chất, phân phối điện và làm mát.

-

Nguồn điện trở thành tài nguyên khan hiếm mới: Ở một số khu vực, GPU không còn là tài sản khó kiếm nhất — mà nguồn điện ổn định, lâu dài còn khan hiếm hơn.

-

Vai trò của làm mát và làm mát bằng chất lỏng tăng nhanh: Khi mật độ công suất cụm AI tăng, phương pháp làm mát truyền thống ngày càng không đủ.

-

Kết nối tốc độ cao quyết định hiệu quả cụm: Khi sức mạnh tính toán mở rộng, hiệu suất hệ thống phụ thuộc ít vào từng card mà nhiều hơn vào kiến trúc mạng và chuyển mạch.

Do đó, cạnh tranh cốt lõi của hạ tầng AI không còn là đột phá đơn điểm, mà là hợp tác cấp hệ thống.

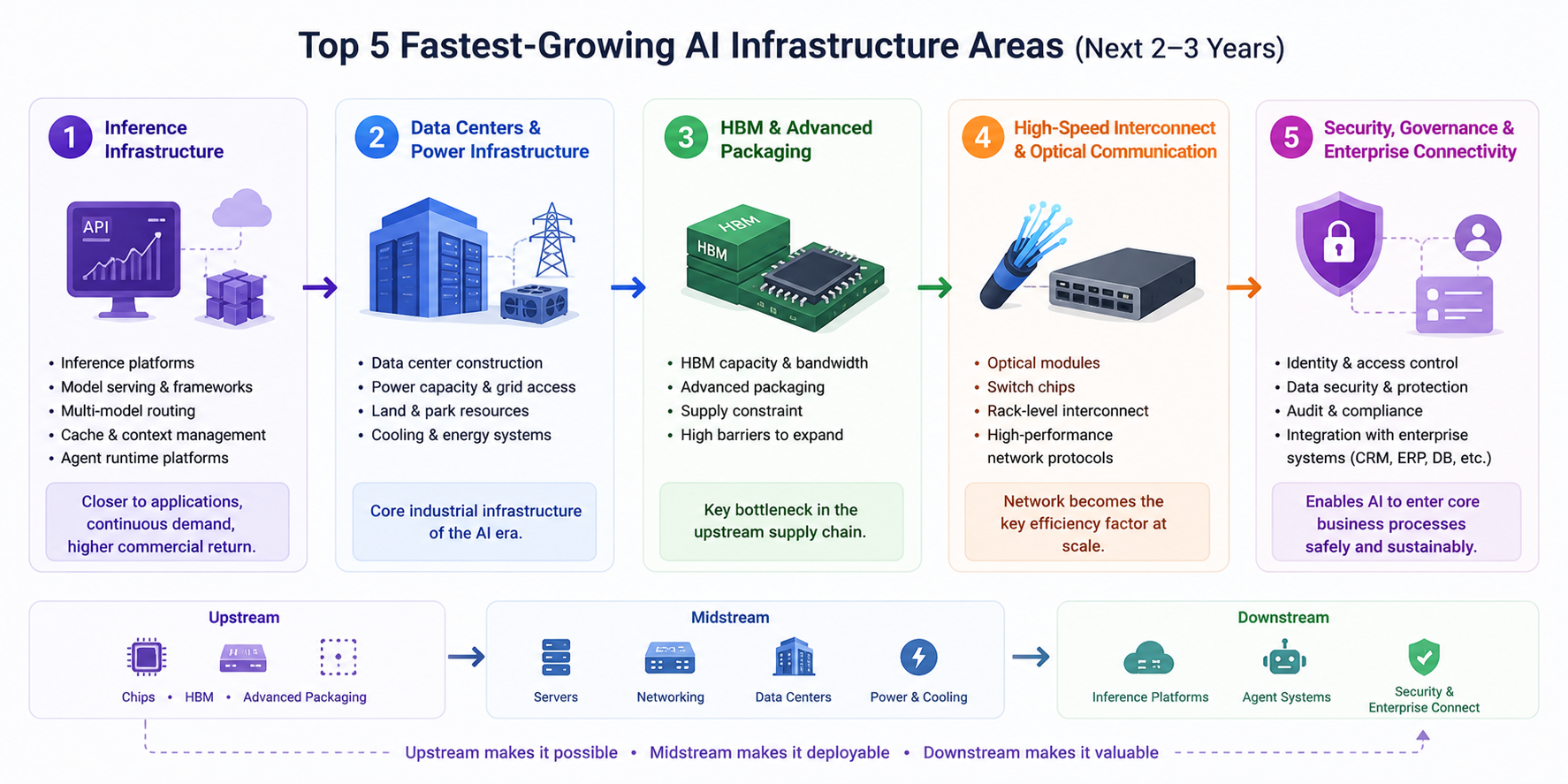

Năm hướng phát triển nhanh nhất trong 2–3 năm tới

Dựa trên thông tin công khai gần đây và sự dịch chuyển trong chuỗi ngành, các hướng phát triển nhanh nhất của hạ tầng AI trong 2–3 năm tới có thể tổng kết thành năm nhóm:

-

Hạ tầng suy luận: Đây là lĩnh vực đáng chú ý nhất. Khi ứng dụng AI tiến nhanh vào sản xuất, nền tảng suy luận, khung dịch vụ mô hình, định tuyến đa mô hình, bộ nhớ đệm và quản lý ngữ cảnh, nền tảng vận hành Agent sẽ mở rộng nhanh chóng. So với đào tạo, nhu cầu suy luận phân tán hơn, liên tục và gần với lợi ích thương mại hơn.

-

Trung tâm dữ liệu và hỗ trợ nguồn điện: Trung tâm dữ liệu đang trở thành hạ tầng công nghiệp cốt lõi của thời đại AI. Ai đảm bảo được hạn mức điện, đất, điều kiện khuôn viên và hệ thống làm mát nhanh hơn sẽ có lợi thế cho làn sóng mở rộng sức mạnh tính toán tiếp theo. Trong vài năm tới, tốc độ xây dựng trung tâm dữ liệu sẽ quyết định tốc độ phát triển ngành AI.

-

HBM và đóng gói nâng cao: Đây vẫn là điểm nghẽn quan trọng nhất của chuỗi cung ứng thượng nguồn. Khi hiệu suất chip tăng, yêu cầu về dung lượng HBM, băng thông và công nghệ đóng gói cũng tăng, trong khi năng lực liên quan khó mở rộng nhanh — nghĩa là triển vọng tăng trưởng cao sẽ còn tiếp diễn.

-

Kết nối tốc độ cao và truyền thông quang: Khi cụm AI mở rộng, mạng lưới trở thành biến số then chốt cho hiệu quả tổng thể. Module quang, chip chuyển mạch, kết nối rack-level và giao thức mạng hiệu quả hơn sẽ là năng lực nền tảng thiết yếu cho đào tạo và suy luận.

-

Quản trị bảo mật và kết nối doanh nghiệp: Dù lĩnh vực này chưa nổi bật bằng chip trong ngắn hạn, giá trị dài hạn rất lớn. Khi AI doanh nghiệp được tích hợp với CRM, ERP, cơ sở dữ liệu, kho mã nguồn và hệ tri thức, kiểm soát truy cập, kiểm toán, bảo vệ dữ liệu nhạy cảm, theo dõi kết quả và quản trị tuân thủ sẽ trở thành thiết yếu. Lớp này quyết định AI có thể thực sự đi vào quy trình kinh doanh cốt lõi hay không.

Đường truyền dẫn có thể tổng kết thành mạch chính rõ ràng:

- Thượng nguồn: chip, HBM, đóng gói nâng cao

- Trung nguồn: máy chủ, mạng chuyển mạch, trung tâm dữ liệu, nguồn điện và làm mát

- Hạ nguồn: nền tảng suy luận, hệ thống Agent, quản trị bảo mật và tích hợp doanh nghiệp

Thượng nguồn quyết định “có thể xây dựng được không”, trung nguồn quyết định “có thể triển khai được không”, hạ nguồn quyết định “có thể sử dụng và tiếp tục tạo giá trị không”.

Kết luận: Cạnh tranh AI bước vào kỷ nguyên kỹ thuật hệ thống

Những năm gần đây, thị trường ban đầu tập trung vào chip và HBM vì đây là các lĩnh vực khan hiếm nhất và có câu chuyện cung cầu rõ ràng nhất. Nhưng khi AI chuyển từ cuộc đua đào tạo sang triển khai suy luận, logic ngành đã thay đổi căn bản. Trong tương lai, yếu tố quyết định tăng trưởng không chỉ là hiệu suất chip đơn lẻ, mà là liệu toàn bộ hạ tầng có thể vận hành đồng bộ hay không.

Khung phân tích rõ ràng hơn cho giai đoạn hiện tại của hạ tầng AI là:

- Đào tạo xác lập giới hạn trên của năng lực

- Suy luận quyết định quy mô thương mại hóa

- Trung tâm dữ liệu và nguồn điện quyết định tốc độ mở rộng

- Quản trị bảo mật quyết định độ sâu áp dụng doanh nghiệp

Điều này có nghĩa là cơ hội hạ tầng AI trong làn sóng tiếp theo sẽ không chỉ giới hạn ở chip, mà sẽ mở rộng ra “hạ tầng suy luận + trung tâm dữ liệu + hệ thống nguồn điện + kết nối tốc độ cao + nền tảng quản trị doanh nghiệp”.

Về dài hạn, AI đang chuyển từ ngành cạnh tranh mô hình sang ngành kỹ thuật hệ thống. Ai tạo được sự phối hợp giữa sức mạnh tính toán, mạng lưới, năng lượng và nền tảng vận hành sẽ có vị trí dẫn đầu cho sự mở rộng ngành trong 2–3 năm tới.

Nhắc nhở rủi ro: Bài viết này không phải là lời khuyên đầu tư và chỉ mang tính tham khảo thông tin. Vui lòng đầu tư cẩn trọng.

Bài viết liên quan

Phân tích nguồn lợi nhuận của USD.AI: cách các khoản vay hạ tầng AI tạo ra lợi nhuận

USD.AI tokenomics: phân tích chuyên sâu về việc sử dụng token CHIP và các cơ chế khuyến khích

GateClaw và AI Skills: Phân tích kỹ thuật về khung năng lực dành cho các tác nhân AI Web3

Các tính năng nổi bật của GateClaw: Khám phá chuyên sâu năng lực của Trạm làm việc AI Web3 Agent

TAO là gì? Phân tích chuyên sâu về tokenomics, mô hình cung ứng và cơ chế khuyến khích của Bittensor