GPT-5.4 Mini 上线!运行速度翻倍,小模型更具实用度

OpenAI 于 3 月 18 日发布 GPT-5.4 Mini 与 GPT-5.4 Nano,两款专为高容量 AI 工作负载设计的轻量模型,在 GPT-5.4 旗舰版发布不到两周后再次迭代。GPT-5.4 Mini 速度较前代 GPT-5 Mini 快两倍,GPT-5.4 Nano 则以更低成本针对即时对话场景优化。

小模型的核心逻辑:准确性并非永远是瓶颈

OpenAI 将 GPT-5.4 Mini 与 Nano 定位为「迄今功能最强大的小型模型」,但这并非旗舰版的缩水品。它们是基于不同优先顺序的设计选择:当任务的实际瓶颈是速度与成本,而非推理深度时,更小的模型往往更具实用性。

以客服系统为例:若每天回答固定的 200 个问题,博士级推理能力的边际收益几乎为零,而每次响应不到一秒、每次回复仅需几分之一美分的成本,才是系统能否规模化的关键。

目前一个较为高效的工作流程架构是:让旗舰模型(如 GPT-5.4)负责任务规划与协调,Mini 或 Nano 则并行处理大量重复性子任务——例如代码库搜索、文件读取或表单处理。Perplexity 副首席技术长 Jerry Ma 在测试后表示:「Mini 模型推理能力强,而 Nano 模型响应迅速且高效,适用于即时对话工作流程。」

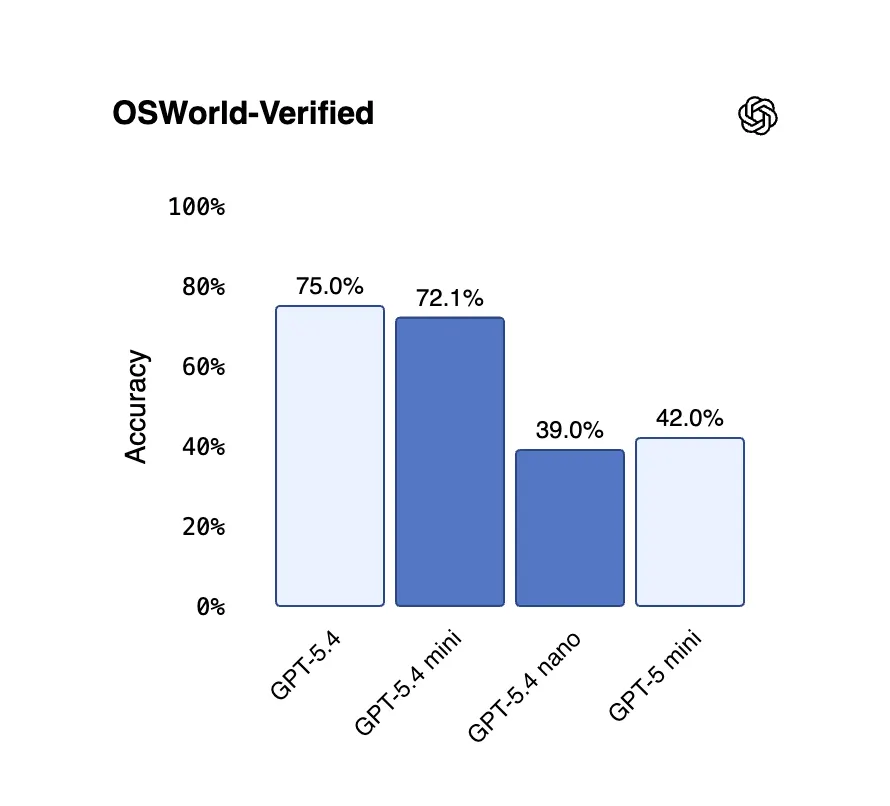

基准测试数据:Mini 已超越人类电脑操作基准

(来源:OpenAI)

(来源:OpenAI)

从公开基准数据看,GPT-5.4 Mini 的表现已相当接近旗舰:

SWE-Bench Pro(评估修复 GitHub 实际程序码问题的能力):GPT-5.4 Mini 得分 54.4%;旧版 GPT-5 Mini 为 45.7%;GPT-5.4 旗舰版为 57.7%

OSWorld-Verified(通过截图评估实际操作桌面的能力):Mini 得分 72.1%;GPT-5.4 旗舰版为 75.0%;人类基准线为 72.4%——Mini 已超越人类基准

GPT-5.4 Nano:SWE-Bench Pro 52.4%、OSWorld-Verified 39.0%,低于 Mini,但较前代 Nano 系列仍是重大进步

这组数据说明:在需要操作桌面或处理代码的场景,Mini 的表现几乎与旗舰版并驾齐驱;Nano 虽准确性较低,但在即时性要求高的场景仍具有独特的成本效益优势。

定价结构与可用性:开发者 vs 一般用户的不同入口

API 定价:GPT-5.4 Mini 每百万输入 Token $0.75,每百万输出 Token $4.50;GPT-5.4 Nano 每百万输入 Token $0.20,每百万输出 Token $1.25——Nano 输入定价约为 Mini 的四分之一。

用户可用性:GPT-5.4 Mini 已向 ChatGPT Free 及 Go 方案用户开放,可通过「+」菜单的「思考」选项访问;付费用户达到 GPT-5.4 使用频率上限时,系统将自动切换至 Mini。GPT-5.4 Nano 目前仅提供 API 访问,定位为开发者工具,不直接面向消费者。

常见问题

GPT-5.4 Mini 与 GPT-5.4 旗舰版的主要差异是什么?

GPT-5.4 Mini 在速度上比前代 GPT-5 Mini 快两倍以上,在 OSWorld-Verified 测试中得分 72.1%,已超越人类 72.4% 的基准线,仅略低于旗舰版的 75.0%。主要差异在推理深度与复杂任务的处理能力,而 Mini 的速度与成本优势使其在大量重复性任务中更具实用性。

GPT-5.4 Nano 的最佳使用场景是什么?

GPT-5.4 Nano 定位为 API 开发者工具,最适合需要即时回应的轻量对话工作流程,例如即时客服系统或每日大规模自动化查询。其输入定价每百万 Token 仅 $0.20,使新创公司大规模部署在经济上具有可行性。

如何在 ChatGPT 中使用 GPT-5.4 Mini?

GPT-5.4 Mini 目前向 ChatGPT Free 及 Go 方案用户开放,可于 ChatGPT 界面「+」菜单的「思考」选项访问。付费用户在达到 GPT-5.4 使用频率限制时,系统将自动切换至 Mini 版本。