Elon Musk demanda a xAI en Colorado y afirma que la normativa sobre IA vulnera la libertad de expresión

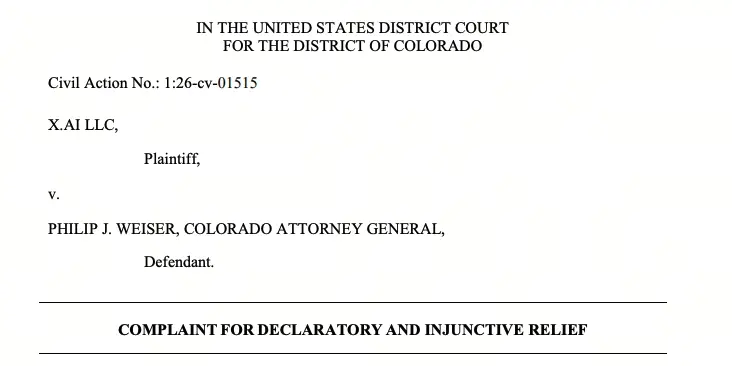

La empresa de inteligencia artificial xAI, propiedad de Musk, presentó el jueves una demanda ante el tribunal federal de distrito en el estado de Colorado, en Estados Unidos, con el objetivo de impedir que el Proyecto de Ley del Senado del estado de Colorado No. 24-205 (SB 24-205) entre en vigor según lo previsto el 30 de junio. La ley busca evitar que los sistemas de IA produzcan “discriminación algorítmica” en los ámbitos del empleo, la vivienda y los servicios financieros. xAI sostiene que la normativa obliga a Grok a generar información de acuerdo con su postura política, lo que vulnera la libertad de expresión.

Argumentos constitucionales de xAI: la salida de la IA es un discurso protegido

(Fuente: CourtListener)

(Fuente: CourtListener)

En los documentos de la demanda, xAI afirma de manera explícita que el estado de Colorado no puede forzar cambios en la salida de información de xAI solo porque quiera promover una determinada postura en temas altamente politizados como “la equidad y la igualdad”. La compañía también señala que el SB 24-205 presenta una contradicción lógica fundamental: por un lado, la normativa afirma eliminar la discriminación histórica y aumentar la diversidad; por otro, en sus disposiciones internas autoriza un “trato diferenciado”, y ambas direcciones van en sentido contrario.

Esta no es la primera vez que xAI emprende acciones legales sobre la regulación de la IA. En diciembre de 2025, xAI ya presentó una demanda contra la Ley de Transparencia de Datos de Entrenamiento de IA Generativa de California, alegando que los requisitos de divulgación de información del estado constituyen discurso forzado e involucran la divulgación de secretos comerciales, lo que infringe la Primera Enmienda y la Quinta Enmienda de la Constitución de Estados Unidos. La demanda en Colorado es la segunda acción legal a nivel federal de xAI en el ámbito de la regulación de la IA.

Antecedentes legislativos y puntos de controversia del SB 24-205

El SB 24-205 de Colorado es una de las primeras normas estatales de Estados Unidos contra la discriminación basada en IA en ser aprobadas. Exige que los desarrolladores de sistemas de IA de alto riesgo adopten medidas de cumplimiento para evitar que sus sistemas produzcan un impacto diferencial irrazonable sobre grupos protegidos. Cabe destacar que, antes de que Colorado y California impulsaran sucesivamente legislación sobre IA, hubo acusaciones de que Grok en el pasado publicó declaraciones relacionadas con el racismo, la discriminación por género y el antisemitismo, y algunos legisladores lo consideraron como uno de los motivos para respaldar normas contra la discriminación en IA.

Cuatro argumentos legales fundamentales planteados en la demanda de xAI

Vulneración de la libertad de expresión: La salida de la IA es un discurso protegido por la Primera Enmienda; el gobierno estatal no puede obligar a regular el contenido del discurso.

Incorporación de puntos de vista políticos: La normativa exige que Grok ajuste la salida según la postura política de Colorado, lo que constituye una intervención del contenido liderada por el gobierno.

Contradicción lógica: La normativa, al mismo tiempo que afirma eliminar la discriminación, autoriza el trato diferenciado; las disposiciones internas chocan entre sí.

Interferencia en el objetivo del producto: Obligar a cambiar la salida dificultará el diseño original de Grok de “buscar la verdad al máximo”.

Postura de la Casa Blanca: promover un marco federal unificado en lugar de un mosaico entre estados

David Sacks, asesor de políticas de IA de la Casa Blanca, ha trabajado de manera constante para impulsar que los estados renuncien a elaborar por cuenta propia reglas de supervisión de la IA y sostiene la creación de un estándar federal único. En marzo, hizo públicas estas declaraciones: “50 estados diferentes regulando la IA de 50 maneras distintas generan confusión en el sistema de supervisión; a los innovadores les resulta difícil cumplir”. Sacks actualmente se desempeña como copresidente del recientemente creado Comité Asesor de Tecnología del presidente, con la responsabilidad de coordinar el impulso de un marco federal unificado para la supervisión de la IA.

La acción de xAI al demandar a Colorado, consistente en dirección con la postura de “prioridad federal” defendida por Sacks, intensifica aún más la controversia central en Estados Unidos sobre si la soberanía de la supervisión de la IA debe corresponder al gobierno federal o a los estados.

Preguntas frecuentes

¿Qué acciones específicas de IA regula el SB 24-205 de Colorado?

El SB 24-205 exige que los sistemas de IA de alto riesgo desplegados en ámbitos como la selección para el empleo, las solicitudes de vivienda y los servicios financieros adopten medidas para evitar impactos diferenciales irrazonables sobre grupos protegidos; los desarrolladores deben proporcionar la documentación de cumplimiento correspondiente. Se prevé que la normativa entre en vigor el 30 de junio de 2026.

¿En qué situación se encuentra la demanda que xAI presentó antes contra California?

xAI presentó en diciembre de 2025 una demanda contra la Ley de Transparencia de Datos de Entrenamiento de IA Generativa de California, alegando que los requisitos de divulgación de información constituyen discurso forzado e involucran la divulgación de secretos comerciales, lo que infringe la Primera y la Quinta Enmienda de la Constitución. A la fecha, el caso aún se encuentra en curso en los procedimientos del tribunal federal de Estados Unidos.

¿Qué impacto a largo plazo tendrá esta demanda en el panorama de supervisión de la IA en Estados Unidos?

Si el tribunal respalda el argumento de xAI sobre la Primera Enmienda, podría debilitar la base legal de las normas estatales de IA contra la discriminación y despejar el camino para un marco federal unificado de supervisión de la IA. La orientación que tome este caso afectará directamente las decisiones legislativas de decenas de estados que están considerando elaborar normativas similares.