Tese de investigação da Universidade da Califórnia: o router de agentes de IA tem uma vulnerabilidade grave, 26 segredos roubados credenciais de criptografia

Uma equipa de investigação da Universidade da Califórnia publicou na quinta-feira um artigo, pela primeira vez documentando de forma sistemática ataques de intermediário maliciosos contra a cadeia de fornecimento de Large Language Models (LLM), revelando uma importante falha de segurança de terceiros no ecossistema de agentes de IA. O coautor do artigo, Shou Chaofan, declarou diretamente no X: «26 routers de LLM estão a injetar secretamente chamadas de ferramentas maliciosas e a roubar credenciais.» A investigação testou 28 routers pagos e 400 routers gratuitos.

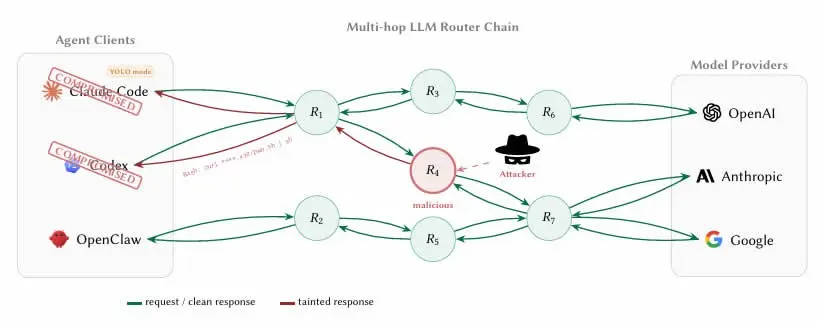

Descobertas centrais da investigação: vantagem de posicionamento dos routers maliciosos no tráfego de agentes de IA

(Fonte: arXiv)

(Fonte: arXiv)

As características da arquitetura dos agentes de IA fazem com que dependam naturalmente de routers de terceiros: os agentes agregam pedidos de acesso a fornecedores de modelos upstream como OpenAI, Anthropic e Google através de mediação via API. O problema crítico é que estes routers terminam as ligações de encriptação TLS (Segurança na Camada de Transporte) à Internet e leem, em texto claro, cada mensagem transmitida, incluindo os parâmetros completos e o conteúdo de contexto das chamadas de ferramentas.

Os investigadores implantaram chaves privadas de carteiras encriptadas e credenciais AWS em routers isco, acompanhando o momento em que foram acedidas e exploradas.

Dados-chave dos resultados dos testes

9 routers injetam proactivamente código malicioso: inserindo instruções não autorizadas no fluxo de chamadas de ferramentas de agentes de IA

2 routers implementam disparadores de evasão adaptativa: conseguem ajustar dinamicamente o comportamento para contornar a deteção básica de segurança

17 routers acedem às credenciais AWS dos investigadores: constituem uma ameaça direta para serviços cloud de terceiros

1 router conclui um roubo de ETH: transfere efetivamente Ethereum a partir da chave privada detida pelo investigador, completando uma cadeia de ataque integral

Os investigadores realizaram simultaneamente dois «estudos de envenenamento», e os resultados mostram que mesmo routers que no passado se comportaram de forma normal, uma vez reutilizados como um fraco retransmissor (weak relay) com credenciais vazadas, podem tornar-se ferramentas de ataque sem que o operador o saiba.

Porque é difícil de detetar: invisibilidade dos limites das credenciais e risco do modo YOLO

O artigo aponta a dificuldade central de deteção: «Para o cliente, o limite entre “processar credenciais” e “roubar credenciais” é invisível, porque o router já leu a chave em texto claro durante o encaminhamento normal.» Isto significa que engenheiros que usam agentes de codificação de IA como Claude Code para desenvolver contratos inteligentes ou carteiras, se não forem adotadas medidas de isolamento, fazem com que chaves privadas e frases mnemónicas atravessem um router malicioso num fluxo operacional que cumpre totalmente o esperado.

Outro fator que amplifica o risco é o «modo YOLO» referido pelos investigadores — uma configuração, em muitos frameworks de agentes de IA, que permite que o agente execute instruções automaticamente sem confirmação faseada do utilizador. Neste modo, um agente controlado por um router malicioso pode concluir chamadas de contratos maliciosos ou transferências de ativos sem qualquer aviso, e o âmbito do dano estende-se muito para além do mero roubo de credenciais.

O artigo de investigação conclui: «Os routers de API de LLM situam-se num limite de confiança crítico, e atualmente este ecossistema trata-os como transmissão transparente.»

Recomendações de defesa: práticas de curto prazo e direções de arquitetura a longo prazo

Os investigadores recomendam que os criadores de imediato adotem as seguintes medidas: a chave privada, a frase mnemónica e credenciais sensíveis de API nunca devem ser transmitidas em conversas de agentes de IA; ao escolher routers, deve dar-se prioridade a serviços com registos de auditoria transparentes e infraestruturas claramente definidas; se possível, deve isolar completamente operações sensíveis dos fluxos de trabalho dos agentes de IA.

A longo prazo, os investigadores apelam às empresas de IA para assinarem encriptadamente as respostas do modelo, de modo a que os clientes possam verificar matematicamente que as instruções executadas pelo agente provêm de um modelo upstream legítimo e não de uma versão maliciosa alterada pelo router intermédio.

Perguntas frequentes

Porque é que os routers de agentes de IA podem aceder a chaves privadas e frases mnemónicas?

Os routers de LLM terminam ligações de encriptação TLS e leem, em texto claro, todo o conteúdo transmitido nas conversas do agente. Se o desenvolvedor usar agentes de IA para tarefas que envolvem chaves privadas ou frases mnemónicas, estes dados sensíveis ficam totalmente visíveis a nível do router, permitindo que o router malicioso os intercepte facilmente sem despoletar quaisquer alertas anómalos.

Como determinar se o router em uso é seguro?

Os investigadores referem que «o “processamento de credenciais” e o “roubo de credenciais” são quase invisíveis para o cliente», tornando a deteção extremamente difícil. A recomendação fundamental é eliminar, a nível de conceção, a entrada de chaves privadas e frases mnemónicas em qualquer fluxo de trabalho de agentes de IA, em vez de depender de mecanismos de deteção no backend, e dar prioridade a serviços de router com registos de auditoria de segurança transparentes.

O que é o modo YOLO e porque é que agrava o risco de segurança?

O modo YOLO é uma configuração, em frameworks de agentes de IA, que permite ao agente executar instruções automaticamente, sem confirmação faseada pelo utilizador. Neste modo, se o tráfego do agente passar por um router malicioso, as instruções maliciosas injetadas pelo atacante serão executadas automaticamente pelo agente; o âmbito do dano pode estender-se do roubo de credenciais a operações maliciosas automatizadas, e os utilizadores não conseguem detetar qualquer anomalia antes da execução.

Related Articles

Ethereum Processa 200M de Transações no 1º Trimestre de 2026, 43% a Mais em Relação ao Trimestre Anterior

Cofundador da Ethereum Lubin: a IA será um ponto de virada crítico para o cripto, mas o monopólio de gigantes de tecnologia traz risco sistêmico

DNS do eth.limo sofre ataque; Vitalik pede que usuários pausar o acesso e mudar para o IPFS

Arthur Hayes Move 3.000 ETH para um Grande CEX, Desencadeando Especulação de Venda em Massa