DeepSeek V4-Pro запускается с 98% более низкой стоимостью, чем GPT-5.5 Pro

DeepSeek выпустила предварительные версии DeepSeek-V4-Pro и DeepSeek-V4-Flash 24 апреля 2026 года — обе это модели с открытыми весами, с контекстным окном в один миллион токенов и с ценами существенно ниже, чем у сопоставимых западных альтернатив. Модель V4-Pro стоит $1.74 за миллион входных токенов и $3.48 за миллион выходных токенов — примерно 1/20 стоимости Claude Opus 4.7 и на 98% меньше, чем GPT-5.5 Pro, согласно официальным спецификациям компании.

Архитектура модели и масштаб

DeepSeek-V4-Pro имеет 1,6 триллиона общих параметров, что делает её крупнейшей открытой (open-source) моделью на рынке LLM на сегодняшний день. Однако в одном проходе вывода активируются только 49 миллиардов параметров, используя то, что DeepSeek называет подходом Mixture-of-Experts, усовершенствованным с версии V3. Эта конструкция позволяет всей модели оставаться бездействующей, пока для любого конкретного запроса активируются лишь релевантные её фрагменты, снижая вычислительные затраты при сохранении объёма знаний.

DeepSeek-V4-Flash работает в меньшем масштабе: 284 миллиарда общих параметров и 13 миллиардов активных. Согласно бенчмаркам DeepSeek, она «обеспечивает сопоставимую с версией Pro производительность рассуждений при наличии большего бюджета на мышление».

Обе модели поддерживают один миллион токенов контекста как стандартную функцию — примерно 750 000 слов, или примерно вся трилогия «Властелин колец» плюс дополнительный текст.

Технические инновации: механизмы внимания в масштабе

DeepSeek решила проблему вычислительного масштабирования, присущую обработке длинного контекста, изобретя два новых типа внимания — как подробно описано в технической статье компании, доступной на GitHub.

Стандартные механизмы внимания в ИИ сталкиваются с жёсткой проблемой масштабирования: каждый раз, когда длина контекста удваивается, вычислительная стоимость примерно вчетверо растёт. Решение DeepSeek включает два взаимодополняющих подхода:

Сжатое разреженное внимание работает в два шага. Сначала оно сжимает группы токенов — например, каждые 4 токена — в одну запись. Затем вместо того, чтобы уделять внимание всем сжатым записям, оно использует «Lightning Indexer», чтобы выбирать только наиболее релевантные результаты для любого заданного запроса. Это сокращает область внимания модели с миллиона токенов до гораздо меньшего набора важных фрагментов.

Сильно сжатое внимание использует более агрессивный подход: сворачивает каждые 128 токенов в одну запись без разреженного выбора. Хотя это теряет детальную гранулярность, оно даёт чрезвычайно дешёвое глобальное представление. Оба типа внимания работают в чередующихся слоях, позволяя модели сохранять и детализацию, и обзор.

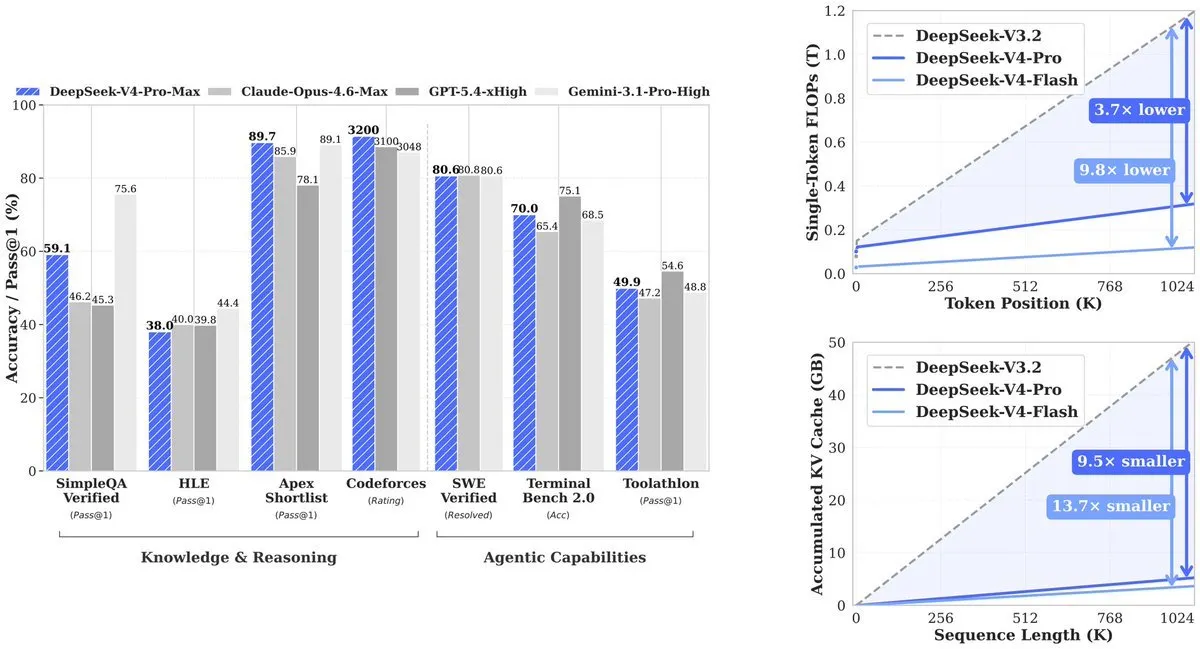

Итог: V4-Pro использует 27% вычислений, которые потребовались предшественнику (V3.2). KV cache — память, нужная для отслеживания контекста — падает до 10% от V3.2. V4-Flash продвигает эффективность ещё дальше: 10% вычислений и 7% памяти по сравнению с V3.2.

Производительность в бенчмарках и конкурентные позиции

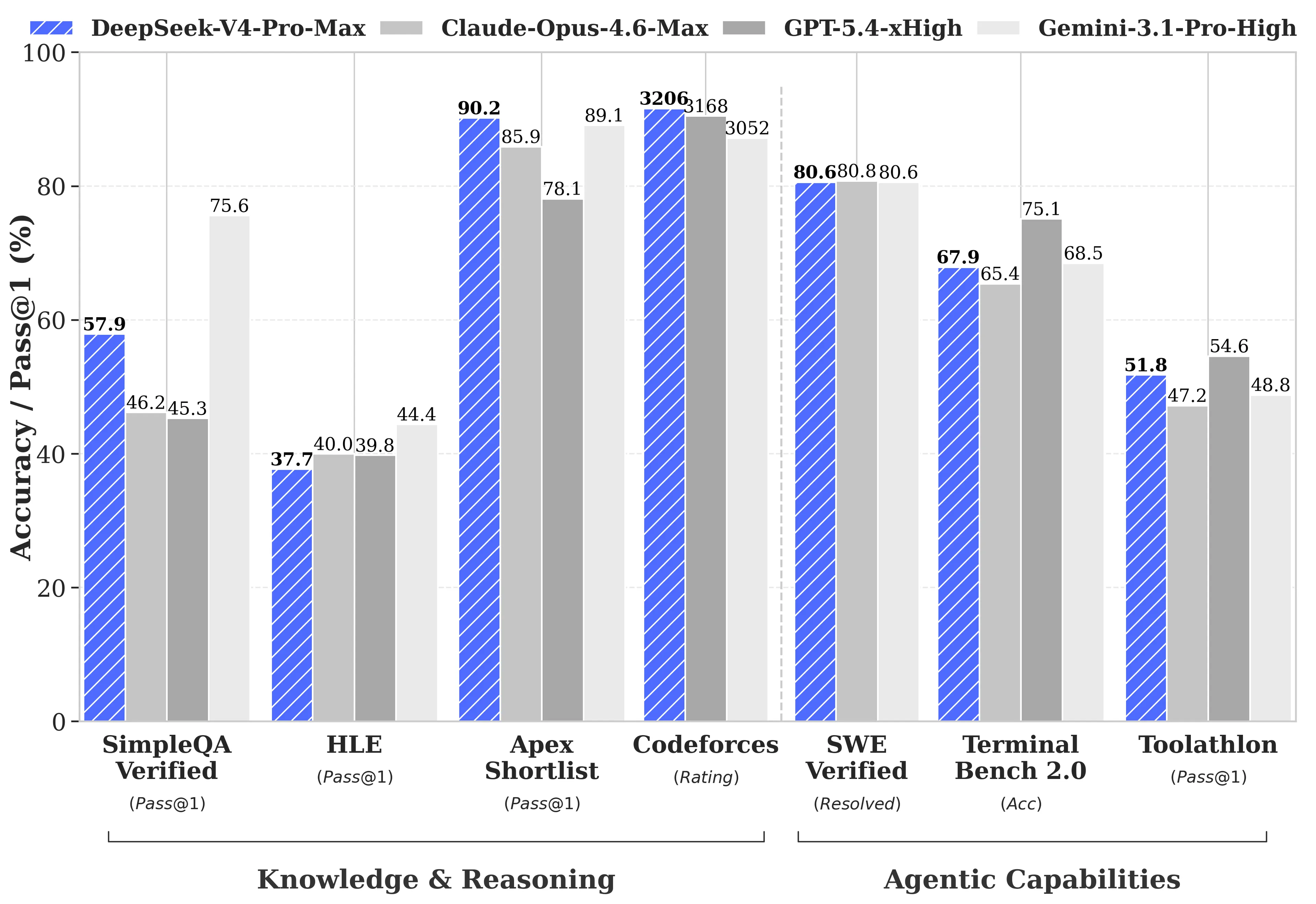

DeepSeek опубликовала подробные сравнения бенчмарков с GPT-5.4 и Gemini-3.1-Pro, включая области, где V4-Pro уступает конкурентам. В задачах на рассуждения V4-Pro отстаёт от GPT-5.4 и Gemini-3.1-Pro примерно на три–шесть месяцев, согласно техническому отчёту DeepSeek.

Где V4-Pro лидирует:

- Codeforces (соревновательное программирование): V4-Pro набрала 3,206, занимая примерно 23-е место среди реальных участников человеческих состязаний

- Apex Shortlist (отобранные задачи по математике и STEM): 90.2% проходов против 85.9% у Opus 4.6 и 78.1% у GPT-5.4

- SWE-Verified (разрешение issues на GitHub): 80.6%, совпадает с Claude Opus 4.6

Где V4-Pro уступает:

- MMLU-Pro (многозадачность): Gemini-3.1-Pro на 91.0% против 87.5% у V4-Pro

- GPQA Diamond (экспертные знания): Gemini на 94.3 против 90.1 у V4-Pro

- Последний экзамен человечества (уровень выпускника): Gemini-3.1-Pro на 44.4% против 37.7% у V4-Pro

В задачах с длинным контекстом V4-Pro лидирует среди open-source моделей и обгоняет Gemini-3.1-Pro на CorpusQA (имитации реального анализа документов при одном миллионе токенов), но уступает Claude Opus 4.6 на MRCR, который измеряет извлечение конкретной информации, спрятанной глубоко в длинном тексте.

Агентные и кодинговые возможности

V4-Pro может работать в Claude Code, OpenCode и других инструментах для кодинга на ИИ. Согласно внутреннему опросу DeepSeek среди 85 разработчиков, которые использовали V4-Pro как своего основного агента для кодинга, 52% сказали, что он готов быть их моделью по умолчанию, 39% склонялись к «да», и менее 9% сказали «нет». Внутреннее тестирование DeepSeek показало, что V4-Pro превосходит Claude Sonnet и приближается к Claude Opus 4.5 в агентных задачах по кодингу.

Artificial Analysis поставила V4-Pro на первое место среди всех моделей с открытыми весами по GDPval-AA — бенчмарку, который тестирует экономически ценную работу с знаниями в сферах финансов, права и исследований. V4-Pro-Max набрала 1,554 Elo, опережая GLM-5.1 (1,535) и MiniMax’s M2.7 (1,514). Claude Opus 4.6 набирает 1,619 на том же бенчмарке.

V4 вводит «перемежающееся мышление» (interleaved thinking), которое сохраняет всю цепочку рассуждений по вызовам инструментов. В предыдущих моделях, когда агент делал несколько вызовов инструментов — например, искал в вебе, запускал код, затем снова искал — контекст рассуждений модели сбрасывался между раундами. V4 сохраняет непрерывность рассуждений между шагами, предотвращая потерю контекста в сложных автоматизированных рабочих процессах.

Конкурентный ландшафт и контекст ценообразования

Релиз V4 выходит на фоне значительной активности в AI-сфере. Anthropic выпустила Claude Opus 4.7 16 апреля 2026 года. GPT-5.5 от OpenAI запущена 23 апреля 2026 года, при этом GPT-5.5 Pro стоит $30 за миллион входных токенов и $180 за миллион выходных токенов. GPT-5.5 обгоняет V4-Pro на Terminal Bench 2.0 (82.7% против 70.0%), что тестирует сложные рабочие процессы агентных команд в командной строке.

Xiaomi выпустила MiMo V2.5 Pro 22 апреля 2026 года, предоставив полные мультимодальные возможности (image, audio, video) по $1 input и $3 output за ( миллион токенов. Tencent выпустила Hy3 в тот же день, что и GPT-5.5.

Для понимания цен: CEO Cline Сауд Ризван отметил, что если бы Uber использовал DeepSeek вместо Claude, её бюджет на AI в 2026 году — как сообщается, достаточный на четыре месяца использования — просуществовал бы семь лет.

![Pricing comparison and Uber budget analysis])https://img-cdn.gateio.im/social/moments-0ee5a4bf95-cbc5686e31-8b7abd-badf29

Развёртывание и доступность

Обе модели V4-Pro и V4-Flash распространяются под лицензией MIT и доступны на Hugging Face. Пока что модели являются текстовыми; DeepSeek заявила, что работает над мультимодальными возможностями. Обе модели можно запускать бесплатно на локальном оборудовании или настраивать в зависимости от потребностей компании.

Существующие конечные точки deepseek-chat и deepseek-reasoner от DeepSeek уже маршрутизируют запросы на V4-Flash в режимах non-thinking и thinking соответственно. Старые конечные точки deepseek-chat и deepseek-reasoner будут сняты 24 июля 2026 года.

DeepSeek обучила V4 частично на чипах Huawei Ascend, обходя ограничения на экспорт со стороны США. Компания заявила, что после выхода в работу 950 новых суперузлов позже в 2026 году цена Pro-модели — уже довольно низкая — снизится ещё сильнее.

Практические последствия

Для предприятий структура цен может изменить расчёты «стоимость–выгода». Модель, лидирующая в open-source бенчмарках при цене $1.74 за миллион входных токенов, делает крупномасштабную обработку документов, юридическую проверку и пайплайны генерации кода существенно дешевле, чем полгода назад. Контекст на один миллион токенов позволяет обрабатывать целые кодовые базы или юридические документы в одном запросе, вместо разбиения на фрагменты в нескольких вызовах.

Для разработчиков и независимых создателей первоочередным вариантом является V4-Flash. При цене $0.14 за вход и $0.28 за выход за миллион токенов он дешевле, чем модели, которые год назад считались бюджетными опциями, при этом обрабатывает большинство задач, которые решает версия Pro.