Маск високо оцінив Seedance 2.0 «надто швидкий розвиток AI-відео»! 字節跳動 вважає, що модель недостатньо досконала

字節跳動 відео-модель Seedance 2.0 у закордонних країнах стала надзвичайно популярною, Ілон Маск захоплюється: «Розвиток надто швидкий». Ця модель вже повністю інтегрована у Doubao, Jiumeng та відкритий корпоративний доступ, а 14 лютого буде випущено серію важливих оновлень, зокрема Doubao Large Model 2.0.

(Передісторія: Материнська компанія TikTok ByteDance витратила 23 мільярди доларів! Планує захопити ринок ШІ до 2026 року)

(Додатковий фон: Інструмент для відеогенерації OpenAI Sora офіційно запущений! П’ять ключових функцій та підписка — все одним поглядом)

Зміст статті

- Маск поширив пост, підвищуючи інтерес за кордоном

- Від внутрішнього тестування до повної інтеграції: Doubao, Jiumeng та Volcano Ark одночасно просуваються

- Мульти-модальність, довгий наратив та синхронізація аудіо та відео — орієнтація на «професійні виробничі сценарії»

- «Ще далеко не ідеально»: недоліки та обмеження чітко зазначені у описі продукту

- Випуск 14 лютого та новий рівень оновлень — новий фактор у розвитку

Відео-модель Seedance 2.0 від ByteDance стала популярною за кордоном, Маск захоплюється «надто швидким розвитком». Ця модель вже повністю інтегрована у Doubao, Jiumeng та відкритий корпоративний доступ, її «мульти-модальне введення» та «довгий наратив з кількома камерами» спрямовані на «професійні виробничі сценарії». ByteDance визнає, що продукт випереджає конкурентів, але ще далекий від ідеалу, і продовжить досліджувати глибоку синхронізацію великих моделей з людським зворотним зв’язком. Випуск Doubao Large Model 2.0 заплановано на 14 лютого.

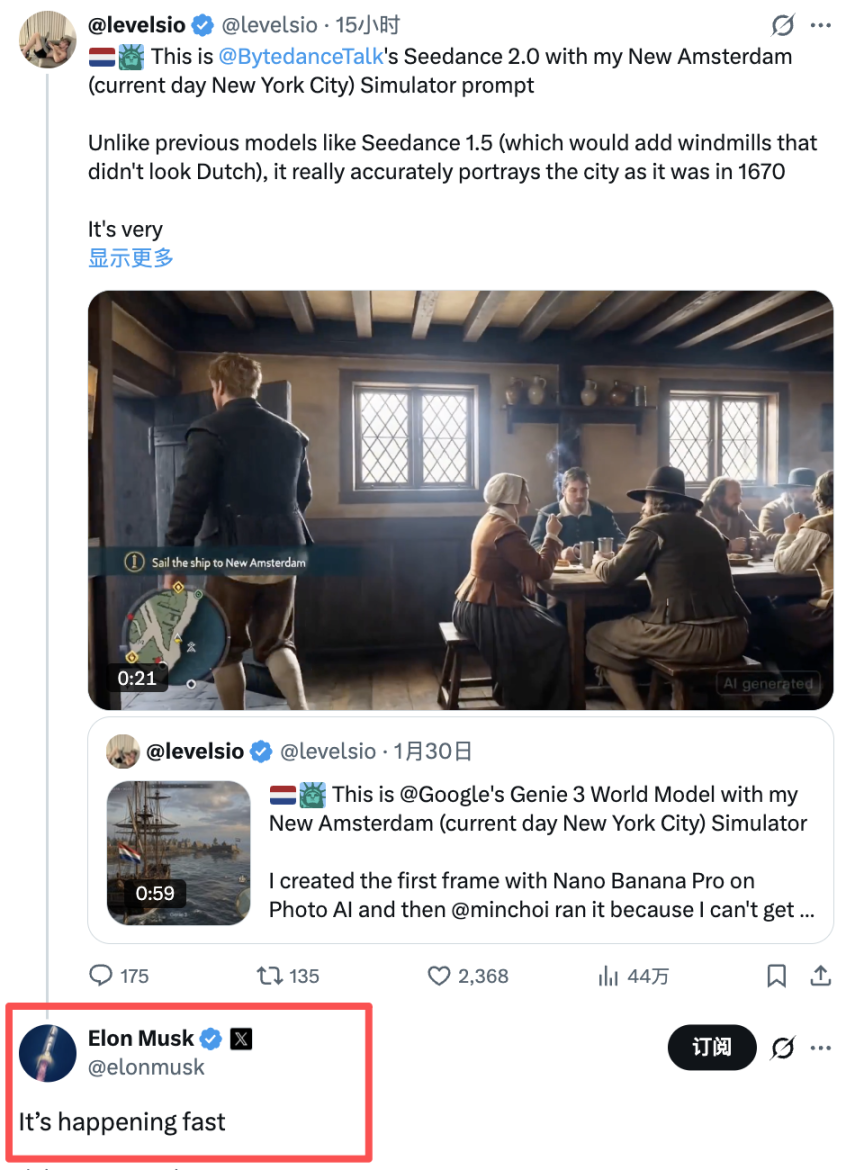

Генеративні відео-моделі швидко входять у масовий продукт та корпоративний інструментарій. Після випуску Seedance 2.0 від ByteDance у закордонних країнах вона швидко стала популярною, Маск у X прокоментував: «It’s happening fast», що ще більше привернуло увагу до здатності відеогенерації.

Оновлення надходять із соціальних платформ. Маск у X прокоментував пости, пов’язані з Seedance 2.0, захоплюючись швидкістю розвитку, що сприяло зростанню обговорень цієї моделі за кордоном та посилило інтерес до її керованості та виробничих можливостей.

Сьогодні ByteDance чітко сигналізує про комерційний запуск продукту. Seedance 2.0 офіційно випущена, повністю інтегрована у Doubao та Jiumeng, а також запущена у центрі досвіду Volcano Ark, відкритому для тестування користувачами. Модель орієнтована на синхронізацію звуку та зображення, багатокамерний довгий наратив, контроль мульти-модального генерування — все для ширшої аудиторії творців та комерційних сценаріїв.

Однак компанія утримується від надмірних заяв. Офіційний акаунт ByteDance зазначає, що Seedance 2.0 «ще далеко не ідеальна», результати генерації мають багато недоліків, і в майбутньому буде продовжуватися глибока синхронізація великих моделей з людським зворотним зв’язком. Для учасників ринку ця «висока публічність + швидка комерціалізація + постійні оновлення» підсилює очікування швидкого зростання конкуренції у сегменті відео-генерації.

Маск поширив пост, підвищуючи інтерес за кордоном

Після внутрішнього тестування Seedance 2.0 завдяки мульти-модальній творчості та «самостійній роботі з камерою» вона викликала високий інтерес у всьому світі. Поширення через X та коментар «It’s happening fast» зробили так, що ця модель почала поширюватися не лише в технічних колах, а й серед інвесторів та продуктових експертів.

Публічний відгук Маска, хоча й не містить технічних деталей, підсилює наратив про «надто швидкий розвиток». Цей сигнал сприяє підвищенню уваги до мульти-модальних можливостей ByteDance і може мати опосередкований вплив на оцінки у відповідних галузях.

Від внутрішнього тестування до повної інтеграції: Doubao, Jiumeng та Volcano Ark одночасно просуваються

ByteDance повідомляє, що відео-модель Seedance 2.0 вже офіційно інтегрована у Doubao App, настільну та веб-версії, а також у повну інтеграцію з продуктами Doubao та Jiumeng, і запущена у центрі досвіду Volcano Ark для тестування користувачами.

Щодо корпоративного сегменту, ByteDance планує наприкінці лютого запустити API Seedance 2.0 у Volcano Ark для допомоги бізнес-клієнтам у реалізації креативних проектів. Це означає, що Seedance 2.0 не лише інструмент для творчості, а й готується до більш стандартизованого B2B використання.

Мульти-модальність, довгий наратив та синхронізація аудіо та відео — орієнтація на «професійні виробничі сценарії»

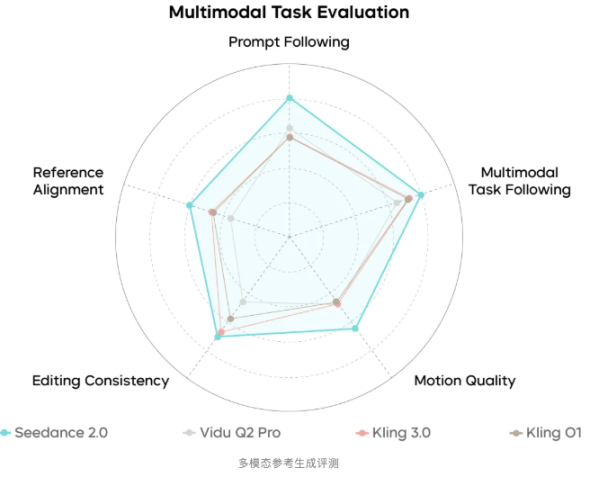

ByteDance підкреслює, що Seedance 2.0 відповідає вимогам «якісного та контрольованого виробництва». Основні функціональні особливості включають:

1, Мульти-модальне введення — підтримка тексту, зображень, аудіо та відео, з можливістю змішування, з урахуванням композиції, руху, роботи камери, спецефектів, звуків тощо.

2, Синхронізація звуку та зображення з багатоканальним виведенням — підтримка фонової музики, звуків навколишнього середовища або голосових коментарів, з акцентом на відповідність ритму.

3, Довгий наратив з кількома камерами та «режисерським підходом» — модель може автоматично аналізувати логіку оповідання, генерувати послідовність кадрів і зберігати цілісність персонажів, світла, стилю та атмосфери.

4, Нові можливості монтажу та подовження відео — для підвищення рівня «режисерського контролю» у робочих процесах.

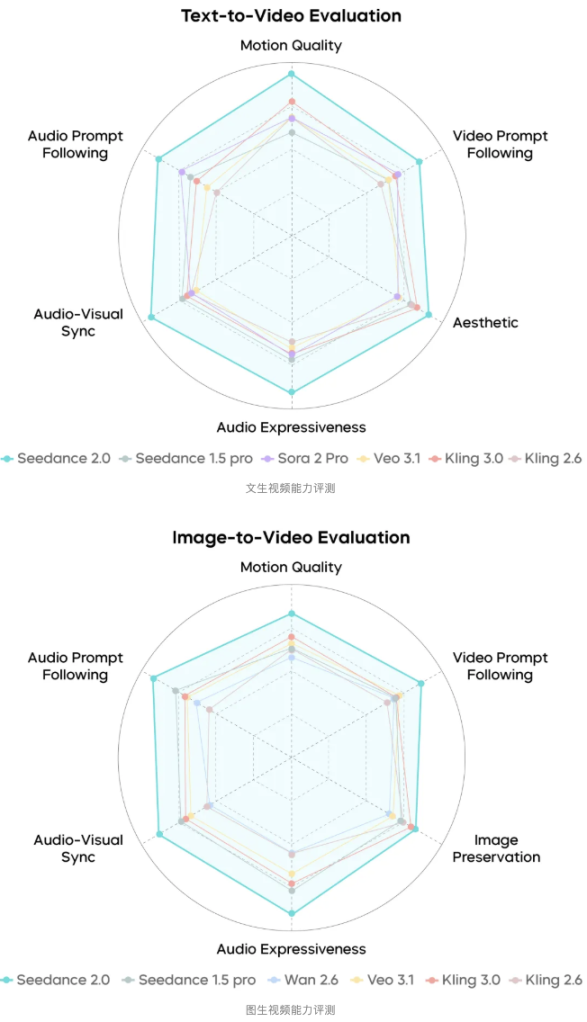

ByteDance також зазначає, що Seedance 2.0 краще вирішує питання фізичних закономірностей та довготривалої стабільності, а у сценах руху рівень генерації досяг рівня SOTA у галузі.

«Ще далеко не ідеально»: недоліки та обмеження чітко прописані у описі продукту

ByteDance заявляє, що Seedance 2.0 демонструє провідний рівень у галузі, але має потенціал для покращення, зокрема у стабільності деталей, відповідності багатоплановим сценам, точності відтворення тексту та складних монтажних ефектах. Компанія продовжить досліджувати глибоку синхронізацію великих моделей з людським зворотним зв’язком.

Відповідність нормативам та межі використання стають більш чіткими. ByteDance зазначає, що Seedance 2.0 наразі обмежує використання реальних зображень або відео як основних об’єктів, і для використання реальних людей потрібно отримати їхню згоду або підтвердження. Такі обмеження безпосередньо впливають на виробництво та розміщення комерційних матеріалів.

14 лютого — дата релізу, новий рівень оновлень

ByteDance планує 14 лютого 2026 року випустити серію важливих оновлень, включаючи Doubao Large Model 2.0, модель для створення відео Seedance 2.0, а також Seedream 5.0 Preview для створення зображень. Очікується значне підвищення базових можливостей моделей та корпоративних агентів.

Після зовнішнього відгуку Маска про «надто швидкий розвиток», увага ринку зосередиться на двох аспектах: перше — чи буде API Seedance 2.0 запущено швидко та чи зможуть компанії швидко його впровадити, і друге — чи зможуть покращити стабільність, відповідність ритму та складність монтажу, щоб перейти від «вражаючого демонстраційного продукту» до «стійкої виробничої системи».