72 giờ, ba cuộc khủng hoảng: Linh hồn của Anthropic đang bị bán đấu giá

Được viết bởi: Ada, Deep Tide TechFlow

Thứ Ba, ngày 24 tháng Hai. Washington, Lầu Năm Góc.

Giám đốc điều hành Anthropic Dario Amodei ngồi đối diện với Bộ trưởng Quốc phòng Pete Hegseth. Theo các phương tiện truyền thông NPR và CNN, trích dẫn những người quen thuộc với vấn đề này, không khí của cuộc họp là “lịch sự”, nhưng nội dung không lịch sự chút nào.

Hegseth đã đưa ra tối hậu thư cho ông: vào lúc 5:01 chiều thứ Sáu, dỡ bỏ các hạn chế sử dụng quân sự của Claude, cho phép Lầu Năm Góc sử dụng nó cho “tất cả các mục đích hợp pháp”, bao gồm cả việc nhắm mục tiêu vũ khí tự động và giám sát hàng loạt trong nước.

Nếu không, hãy hủy hợp đồng trị giá 200 triệu đô la. Luật Sản xuất Quốc phòng được đưa ra và trưng dụng bắt buộc. Liệt kê Anthropic là một “rủi ro chuỗi cung ứng” tương đương với việc đưa nó vào danh sách đen các thực thể thù địch của Nga và Trung Quốc.

Cùng ngày, Anthropic đã phát hành phiên bản thứ ba của Chính sách mở rộng quy mô có trách nhiệm (RSP 3.0), lặng lẽ loại bỏ một trong những lời hứa cốt lõi của công ty kể từ khi thành lập: không đào tạo các mô hình mạnh hơn nếu các biện pháp bảo mật không được áp dụng.

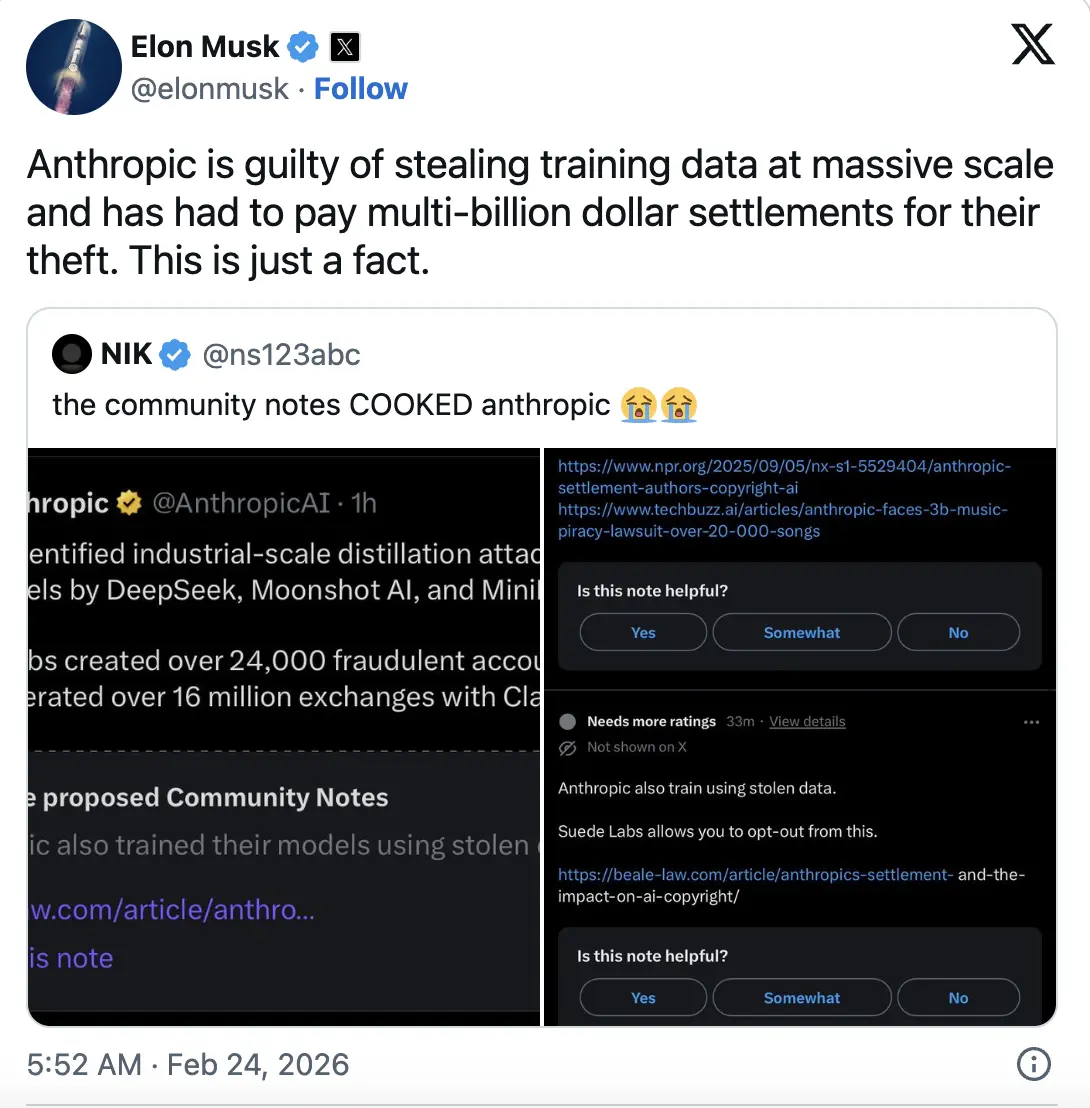

Cũng trong cùng ngày, Elon Musk đã đăng trên X, "Anthropic đánh cắp dữ liệu đào tạo trên quy mô lớn, đó là sự thật. Trong khi đó, một ghi chú cộng đồng trên X bổ sung cho các báo cáo rằng Anthropic đã trả 1,5 tỷ đô la tiền dàn xếp để đào tạo Claude với những cuốn sách lậu.

Trong vòng bảy mươi hai giờ, công ty AI, tuyên bố có “linh hồn”, đóng ba vai trò cùng một lúc: tử vì đạo an ninh, kẻ trộm sở hữu trí tuệ và kẻ phản bội Lầu Năm Góc.

Cái nào đúng?

Có thể cả hai.

Lầu Năm Góc “hoặc tuân theo hoặc lăn lộn”

Lớp đầu tiên của câu chuyện rất đơn giản.

Anthropic là công ty AI đầu tiên nhận được quyền truy cập mật vào Bộ Quốc phòng Hoa Kỳ. Hợp đồng giành được vào mùa hè năm ngoái được giới hạn ở mức 200 triệu đô la. OpenAI, Google và xAI sau đó đã giành được các hợp đồng có cùng quy mô.

Theo Al Jazeera, Claude đã được sử dụng trong một chiến dịch quân sự của Mỹ vào tháng Giêng năm nay. Chiến dịch liên quan đến vụ bắt cóc Tổng thống Venezuela Maduro.

Nhưng Anthropic vạch ra hai lằn ranh đỏ: nó không hỗ trợ nhắm mục tiêu vũ khí hoàn toàn tự động, nó không hỗ trợ giám sát hàng loạt công dân Mỹ. Anthropic tin rằng AI không đủ tin cậy để điều khiển vũ khí và hiện không có luật và quy định nào quy định việc sử dụng AI trong giám sát hàng loạt.

Lầu Năm Góc không mua nó.

Cố vấn AI của Nhà Trắng David Sacks đã công khai cáo buộc Anthropic “sử dụng nỗi sợ hãi như một vũ khí để tham gia vào việc bắt giữ theo quy định” trên X vào tháng Mười.

Các đối thủ cạnh tranh đã quỳ gối. OpenAI, Google, xAI đều đã đồng ý cho phép quân đội sử dụng AI của mình cho “tất cả các tình huống pháp lý”. Grok của Musk vừa được chấp thuận tham gia vào các hệ thống bí mật trong tuần này.

Anthropic là người cuối cùng đứng vững.

Tính đến thời điểm viết bài, Anthropic cho biết trong tuyên bố mới nhất của họ rằng họ không có ý định nhượng bộ. Nhưng hạn chót 5:01 vào thứ Sáu đã ở trong tầm mắt.

Một cựu liên lạc viên giấu tên của Bộ Quốc phòng nói với CNN rằng “làm thế nào bạn có thể tuyên bố một công ty là ‘rủi ro chuỗi cung ứng’ cùng một lúc và buộc công ty này làm việc cho quân đội của bạn?” ”

Câu hỏi hay, nhưng điều này không nằm trong sự cân nhắc của Lầu Năm Góc. Điều họ quan tâm là nếu Anthropic không thỏa hiệp, nó sẽ dùng đến các biện pháp cưỡng chế, hoặc, trở thành những kẻ bị Washington ruồng bỏ.

“Tấn công chưng cất”: một cái tát vào mặt cáo buộc

Vào ngày 23 tháng 2, Anthropic đã đăng một blog có từ ngữ sắc bén cáo buộc ba công ty AI của Trung Quốc tiến hành một “cuộc tấn công chưng cất cấp công nghiệp” vào Claude.

Các bị cáo là DeepSeek, Moonshot AI, MiniMax.

Anthropic cáo buộc họ đã khởi xướng hơn 16 triệu tương tác với Claude thông qua 24.000 tài khoản giả mạo, nhắm vào năng lực cốt lõi của Claude trong việc lập luận nhân viên, gọi công cụ và lập trình.

Anthropic mô tả vụ việc là một mối đe dọa an ninh quốc gia, tuyên bố rằng mô hình chưng cất “không có khả năng giữ lại hàng rào bảo vệ” và có thể được các chính phủ độc tài sử dụng để tấn công mạng, thông tin sai lệch và giám sát hàng loạt.

Câu chuyện là hoàn hảo, và thời gian cũng vậy.

Ngay sau khi chính quyền Trump vừa nới lỏng kiểm soát xuất khẩu chip sang Trung Quốc, nó đến vào thời điểm Anthropic cần tìm đạn dược cho vị trí vận động hành lang kiểm soát xuất khẩu chip của mình.

Nhưng Musk đã bắn một phát súng: “Anthropic đã đánh cắp dữ liệu đào tạo trên quy mô lớn và cũng trả hàng tỷ đô la để dàn xếp cho nó”. Đây là một sự thật. ”

Tory Green, đồng sáng lập công ty cơ sở hạ tầng AI IO.Net, cho biết: “Bạn đào tạo mô hình của riêng mình với dữ liệu từ khắp nơi trên mạng, và sau đó những người khác sử dụng API công khai của bạn để học hỏi từ bạn, được gọi là ‘cuộc tấn công chưng cất’?” ”

Anthropic gọi chưng cất là một “cuộc tấn công”, nhưng đó là một điều phổ biến trong ngành công nghiệp AI. OpenAI sử dụng nó để nén GPT-4, Google sử dụng nó để tối ưu hóa Gemini và thậm chí chính Anthropic cũng đang làm điều đó. Sự khác biệt duy nhất là chính nó được hấp lần này.

Theo Erik Cambria, giáo sư AI tại Đại học Công nghệ Nanyang ở Singapore, ông nói với CNBC: "Ranh giới giữa việc sử dụng hợp pháp và độc hại thường bị xóa nhòa. ”

Trớ trêu hơn nữa, Anthropic vừa trả 1,5 tỷ đô la để đào tạo Claude với những cuốn sách lậu. Nó đào tạo mô hình dựa trên dữ liệu từ khắp mạng và sau đó cáo buộc những người khác học nó bằng cách sử dụng API công khai của nó. Đây không phải là tiêu chuẩn kép, đây là tiêu chuẩn ba.

Anthropic muốn đóng vai nạn nhân, nhưng đã bị bắt làm bị cáo.

Phá dỡ các cam kết an toàn: RSP 3.0

Cùng ngày đối đầu với Lầu Năm Góc và xé toạc Thung lũng Silicon, Anthropic đã phát hành ấn bản thứ ba của Chính sách Mở rộng Có trách nhiệm.

Nhà khoa học trưởng Jared Kaplan của Anthropic cho biết trong một cuộc phỏng vấn với giới truyền thông: "Chúng tôi không cảm thấy việc ngừng đào tạo các mô hình AI sẽ giúp ích cho bất kỳ ai. Cam kết đơn phương trong bối cảnh AI phát triển nhanh chóng… Và các đối thủ cạnh tranh đang đẩy hết tốc độ, điều này không có ý nghĩa. ”

Nói cách khác, nếu người khác không nói về võ thuật, chúng ta sẽ không giả vờ.

Trọng tâm của RSP 1.0 và 2.0 là một cam kết cứng rắn về việc tạm dừng đào tạo nếu khả năng của mô hình vượt quá phạm vi của các biện pháp bảo mật. Cam kết này đã mang lại cho Anthropic một danh tiếng độc đáo trong cộng đồng bảo mật AI.

Nhưng 3.0 đã bị xóa.

Thay vào đó, một khuôn khổ “linh hoạt” hơn được chia thành hai hướng, một mà Anthropic có thể tự thực hiện và các khuyến nghị an toàn đòi hỏi sự hợp tác trong toàn ngành. Gửi báo cáo rủi ro 3-6 tháng một lần. Các chuyên gia bên ngoài được yêu cầu xem xét nó.

Nghe có vẻ có trách nhiệm?

Chris Painter, một nhà đánh giá độc lập từ tổ chức phi lợi nhuận METR, cho biết sau khi đọc dự thảo ban đầu của chính sách: "Điều này cho thấy Anthropic tin rằng họ cần chuyển sang ‘chế độ phân loại’ vì cách tiếp cận để đánh giá và giảm thiểu rủi ro không thể theo kịp tốc độ tăng trưởng công suất. Đây là bằng chứng cho thấy xã hội chưa chuẩn bị cho những rủi ro thảm khốc tiềm ẩn của AI. ”

Theo TIME, Anthropic đã dành gần một năm để thảo luận về việc viết lại nội bộ, và Giám đốc điều hành Amodei và hội đồng quản trị đã bỏ phiếu nhất trí thông qua nó. Tuyên bố chính thức là ý định ban đầu của thiết kế chính sách là thúc đẩy sự đồng thuận của ngành, nhưng ngành công nghiệp này hoàn toàn không theo kịp. Chính quyền Trump đã thực hiện cách tiếp cận tự do đối với phát triển AI và thậm chí cố gắng bãi bỏ các quy định liên quan ở các bang khác nhau. Luật AI ở cấp liên bang còn rất xa. Mặc dù có vẻ như có thể thiết lập một khuôn khổ quản trị toàn cầu vào năm 2023, nhưng ba năm sau, cánh cửa rõ ràng đã đóng lại.

Một nhà nghiên cứu ẩn danh đã theo dõi quản trị AI trong một thời gian dài đã nói trực tiếp hơn: "RSP là tài sản thương hiệu có giá trị nhất của Anthropic. Loại bỏ lời hứa đình chỉ đào tạo giống như một công ty thực phẩm hữu cơ lặng lẽ xé từ ‘hữu cơ’ ra khỏi bao bì và nói với bạn rằng thử nghiệm của họ giờ đây minh bạch hơn. ”

Xé toạc danh tính dưới mức định giá 380 tỷ

Vào đầu tháng 2, Anthropic đã kết thúc vòng gọi vốn 30 tỷ USD với mức định giá 380 tỷ USD, với Amazon là nhà đầu tư chính. Kể từ khi thành lập, nó đã đạt được 14 tỷ đô la doanh thu hàng năm. Con số này đã tăng hơn 10 lần mỗi năm trong ba năm qua.

Đồng thời, Lầu Năm Góc đe dọa đưa nó vào danh sách đen. Musk công khai cáo buộc ông ăn cắp dữ liệu. Các cam kết bảo mật cốt lõi của chính nó bị loại bỏ. Mrinank Sharma, người đứng đầu bộ phận bảo mật AI của Anthropic, đã viết trên X sau khi từ chức: "Thế giới đang gặp nguy hiểm. ”

Mâu thuẫn?

Có lẽ mâu thuẫn nằm ở gen Anthropic.

Công ty được thành lập bởi các cựu giám đốc điều hành của OpenAI vì họ lo ngại rằng OpenAI đang đi quá nhanh về các vấn đề bảo mật. Sau đó, họ tự xây dựng một công ty để xây dựng các mô hình mạnh mẽ hơn với tốc độ nhanh hơn đồng thời nói với thế giới rằng những mô hình này nguy hiểm như thế nào.

Mô hình kinh doanh có thể tóm tắt trong một câu, chúng tôi sợ AI hơn bất kỳ ai khác, vì vậy bạn nên trả tiền cho chúng tôi để xây dựng AI.

Câu chuyện này hoạt động hoàn hảo vào năm 2023-2024. An toàn AI là một từ hot ở Washington và Anthropic là nhà vận động hành lang phổ biến nhất.

Vào năm 2026, gió đã thay đổi.

“AI thức tỉnh” đã trở thành một nhãn hiệu tấn công, các dự luật quy định AI cấp tiểu bang đã bị Nhà Trắng chặn và SB 53 của California do Anthropic hậu thuẫn, mặc dù đã được ký thành luật, nhưng bị bỏ rơi ở cấp liên bang.

Thẻ an toàn của Anthropic đang trượt từ “lợi thế khác biệt” sang “công bằng tiêu cực chính trị”.

Anthropic đang thực hiện một hành động cân bằng phức tạp, nó cần đủ “an toàn” để duy trì thương hiệu và nó cần đủ “linh hoạt” để không bị thị trường và chính phủ bỏ rơi. Vấn đề là không gian dung sai ở cả hai đầu đang bị thu hẹp.

Một câu chuyện bảo mật có giá trị hơn bao nhiêu?

Hãy nhìn vào ba điều cùng nhau, và bức tranh sẽ rõ ràng.

Cáo buộc rằng công ty Trung Quốc chưng cất Claude là để củng cố câu chuyện vận động hành lang về kiểm soát xuất khẩu chip. Để không bị bỏ lại phía sau trong cuộc chạy đua vũ trang, lời hứa đình chỉ an ninh đã bị gỡ bỏ. Từ chối yêu cầu của Lầu Năm Góc về vũ khí tự động là để bảo vệ lớp áo choàng đạo đức cuối cùng.

Mỗi bước đều có logic, nhưng mỗi bước đều mâu thuẫn với nhau.

Bạn không thể nói rằng các công ty Trung Quốc “pha loãng” mô hình của bạn sẽ gây nguy hiểm cho an ninh quốc gia trong khi cắt đứt lời hứa để ngăn chặn mô hình của bạn vượt khỏi tầm kiểm soát. Nếu mô hình thực sự nguy hiểm như vậy, bạn nên thận trọng hơn, không hung hăng hơn.

Trừ khi bạn là Anthropic.

Trong ngành công nghiệp AI, danh tính được xác định không phải bởi các báo cáo của bạn, mà bởi bảng cân đối kế toán của bạn. Câu chuyện “an toàn” của Anthropic về cơ bản là một thương hiệu cao cấp.

Trong những ngày đầu của cuộc chạy đua vũ trang AI, khoản phí bảo hiểm này rất đáng tiền. Các nhà đầu tư sẵn sàng trả mức định giá cao hơn cho “AI có trách nhiệm”, các chính phủ sẵn sàng bật đèn xanh cho “AI đáng tin cậy” và khách hàng sẵn sàng trả tiền cho “AI an toàn hơn”.

Nhưng vào năm 2026, phí bảo hiểm này đang bốc hơi.

Anthropic hiện đang phải đối mặt với không phải là câu hỏi trắc nghiệm “có nên thỏa hiệp hay không” mà là câu hỏi sắp xếp “thỏa hiệp với ai trước”. Thỏa hiệp với Lầu Năm Góc, thương hiệu bị tổn hại. Thỏa hiệp với đối thủ cạnh tranh và lời hứa an toàn bị vô hiệu. Thỏa hiệp với các nhà đầu tư, cả hai bên đều phải nhượng bộ.

Vào thứ Sáu lúc 5:01 chiều, Anthropic sẽ đưa ra câu trả lời của mình.

Nhưng dù câu trả lời là gì, có một điều chắc chắn: Anthropic từng đứng trên “chúng tôi không giống như OpenAI” đang trở nên giống như tất cả mọi người.

Sự kết thúc của một cuộc khủng hoảng danh tính thường là sự biến mất của bản sắc.