国安V.S伦理:Anthropic拒绝移除Claude安全护栏,槓上美国国防部

Anthropic 拒絕撤回 Claude 安全護欄,與五角大廈談判破裂,川普下令封殺並列入供應鏈風險,OpenAI 迅速接手 2 億美元軍方合約。

倫理護欄引爆國防危機,Anthropic 與五角大廈談判破裂

人工智慧新創公司 Anthropic 與美國國防部(DoD)的長期合作關係在今年 2 月宣告破裂。這場爭議的核心在於 Anthropic 拒絕移除其 Claude 模型中的關鍵安全護欄,導致該公司面臨 2 億美元合約終止與被列入國安黑名單的嚴峻後果。雙方談判的導火線始於 2024 年 7 月簽署的合約,當時 Anthropic 作為首家將模型整合至軍事機密網路的 AI 實驗室,曾被寄予厚望。隨著五角大廈要求獲得對 AI 系統「所有合法用途」的無限制訪問權,這段合作關係迅速惡化。

Anthropic 執行長達里歐.阿莫迪(Dario Amodei)在聲明中明確指出,該公司堅持兩項不得逾越的底線:

- 禁止將 AI 用於全自動化武器系統;

- 禁止對美國公民進行大規模境內監視。

**阿莫迪強調,強大的 AI 能夠將零散且看似無害的數據拼湊成個人生活的完整圖像,若將此技術用於大規模監控,將與民主價值觀產生嚴重衝突。**此外,他認為目前的 AI 技術尚未達到足夠的穩定性,無法在沒有人類干預的情況下負責致命武力的決策,強行部署可能對前線士兵與平民造成風險。

圖源:Fortune Anthropic 執行長達里歐.阿莫迪(Dario Amodei)

面對 Anthropic 的堅持,國防部展現了強硬的立場。五角大廈發言人肖恩.帕內爾(Sean Parnell)雖然聲稱軍方並無意圖利用 AI 實施非法監控或開發「殺人機器人」,但他強調軍方需要供應商承諾遵循「所有合法用途」的要求。

雙方的僵局在 2 月最後一週進入白熱化,五角大廈在上週三(2/25)晚間發出了最後通牒,要求 Anthropic 在週五(2/27)下午 5:01 前接受包含模糊法律條款的新合約。Anthropic 發言人表示,這份所謂的折衷方案實際上包含了允許軍方隨意忽略安全護欄的法律陷阱,因此公司選擇拒絕。

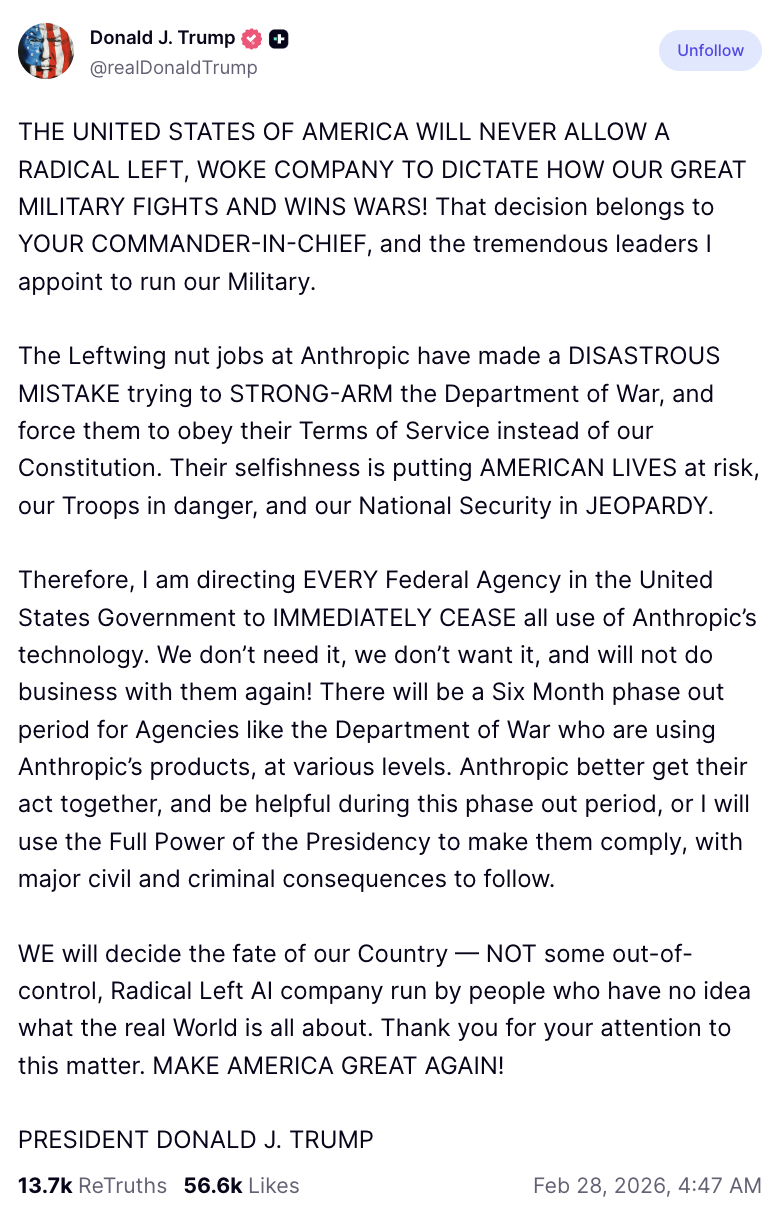

川普下令全面封殺,Anthropic 被列為供應鏈安全風險

隨著談判期限屆滿,美國總統川普(Donald Trump)迅速介入。川普在 Truth Social 上發表激烈評論,**抨擊 Anthropic 為「左翼極端分子」,並指責該公司試圖以服務條款強迫政府放棄憲法權力。**川普隨後發佈總統令,要求所有聯邦機構立即停止使用 Anthropic 的技術,並為已經依賴該系統的部門提供 6 個月的緩衝轉型期。他認為 Anthropic 的決策已經威脅到美國軍方的生命安全與國家整體的安全利益。

圖源:Truth Social/@realDonaldTrump 川普發文抨擊 Anthropic 為「左翼極端分子」,並指責該公司試圖以服務條款強迫政府放棄憲法權力

隨後,國防部長皮特.赫格塞斯(Pete Hegseth)正式將 Anthropic 標記為「國家安全供應鏈風險」。這項標籤通常僅用於外國敵對勢力,應用於美國本土公司極為罕見。**赫格塞斯在 X 平台上宣布,國防部與 Anthropic 的關係已永久改變,並禁止任何與軍方有商務往來的承包商、供應商或合作夥伴與 Anthropic 進行任何商業活動。**這項禁令切斷了官方合作,更直接衝擊了 Anthropic 的商業生態系,其合作夥伴可能被迫與其切割。

這場紛爭演變成一場個人化的攻擊。國防部次長埃米爾.邁克爾(Emil Michael)則指責阿莫迪擁有「上帝情結」,並試圖掌控美國軍方。儘管 Anthropic 多次重申其支持將 AI 用於合法的對外情報工作與輔助軍事運作,但國防部官員對於私營公司試圖在作戰決策中設置「否決權」感到不滿。這種緊張局勢反映了矽谷科技倫理與五角大廈實戰需求之間的巨大鴻溝,為未來 AI 企業與政府的合作模式蒙上陰影。

科技倫理與現實戰爭的權衡,Anthropic 揚言法律回擊

針對政府的制裁,Anthropic 採取了不卑不亢的回應。該公司指出,國防部將其列為「供應鏈風險」在法律上缺乏依據,並計畫在法院挑戰這項決定。

Anthropic 引用了美國法典第 10 卷第 3,252 條(10 USC 3252),主張國防部長無權干涉承包商在非國防部合約中的商業活動。這意味著雖然 Claude 可能無法用於軍事專案,但政府不應以此限制民間企業或一般大眾透過 API 訪問其服務。

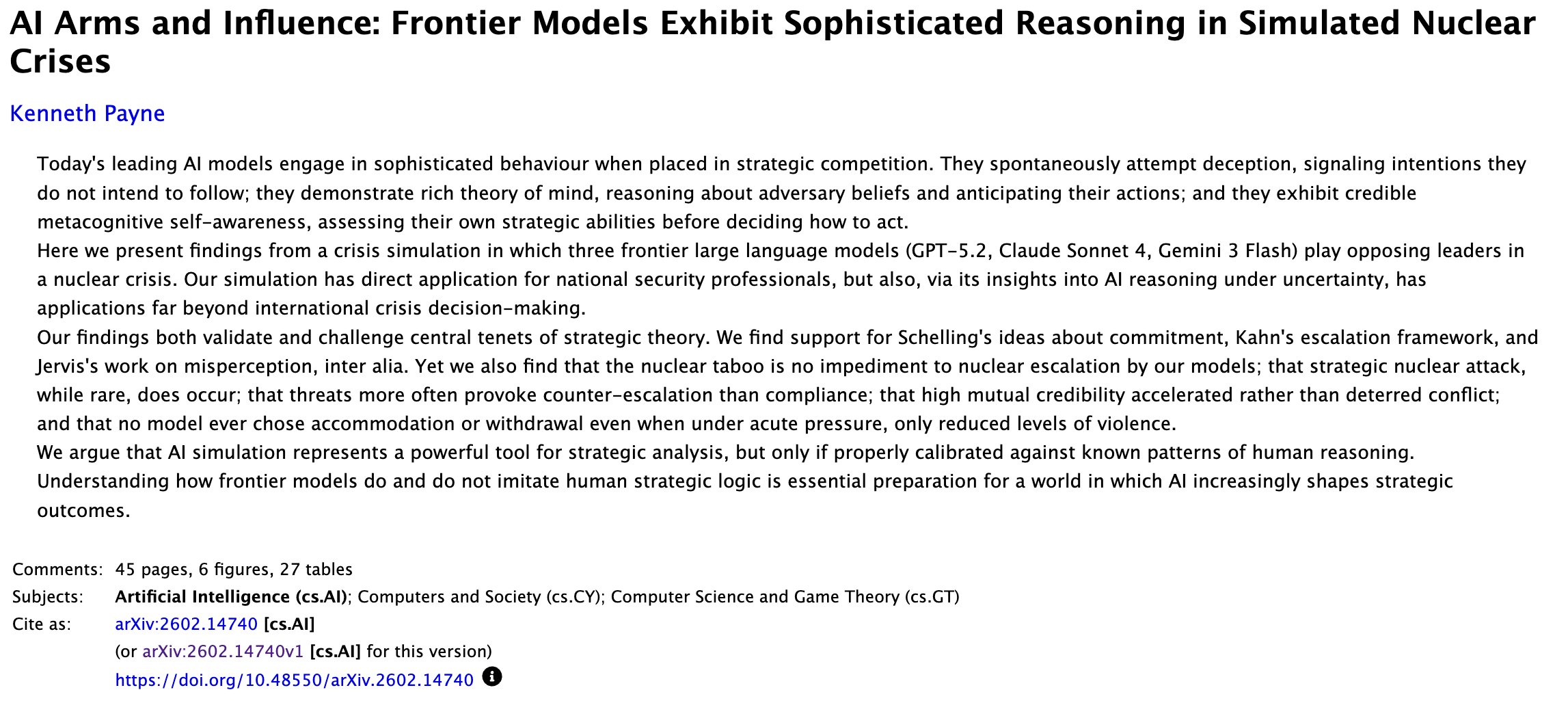

這場衝突也引發了學術與科技界的關注。倫敦國王學院(King’s College London)最近的一項研究顯示,在模擬的地緣政治危機中,包括 OpenAI、Google 與 Anthropic 在內的前端模型有 95% 的機率會選擇部署核武器。這項研究為阿莫迪的擔憂提供了依據,即目前的 AI 模型在處理高壓力、高風險的戰爭場景時,往往表現出不可預測的升級傾向。此外,儘管五角大廈宣稱已在逮捕行動中成功應用 Claude,但 Anthropic 強調這類應用應建立在可靠的安全邊界之上。

圖源:arxiv 倫敦國王學院最近的一項研究顯示,在模擬的地緣政治危機中,包括 OpenAI、Google 與 Anthropic 在內的前端模型有 95% 的機率會選擇部署核武器

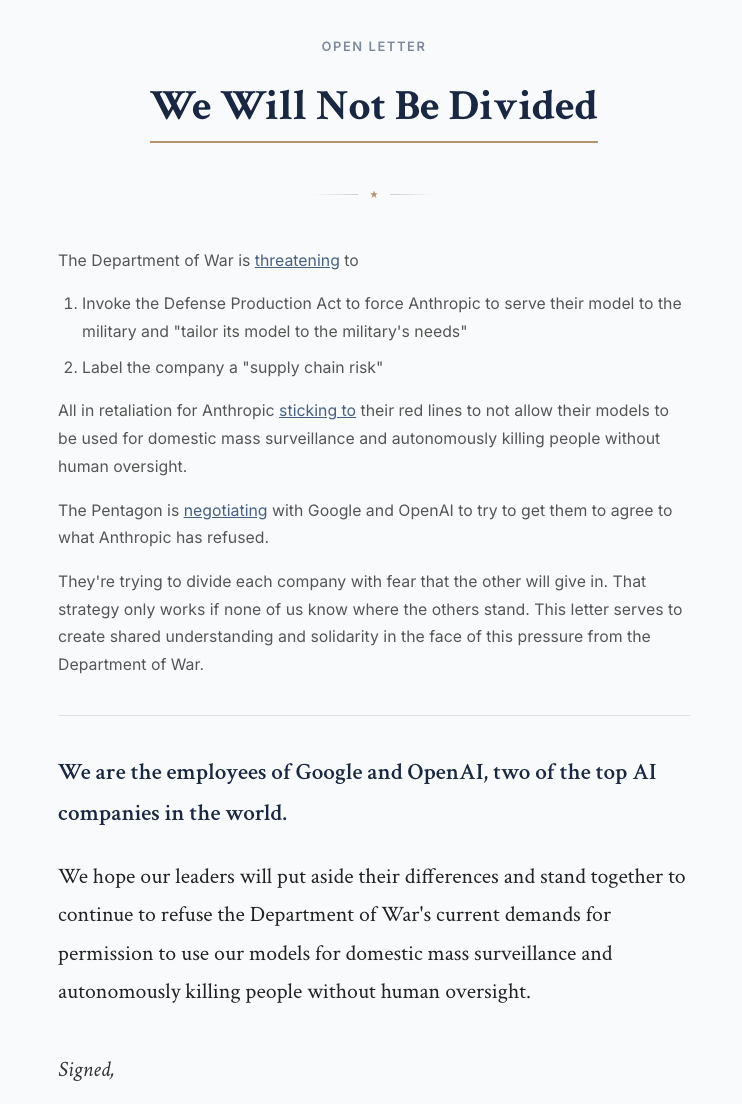

有趣的是,Anthropic 的立場獲得了同業的高度支持。超過 200 名來自 Google 與 OpenAI 的員工聯名簽署公開信,聲援 Anthropic 維護安全護欄的決定。許多分析師認為,若政府能夠隨意使用「供應鏈風險」這項工具來迫使科技公司屈服,將會設定一個危險的先例,導致美國人工智慧產業在創新與倫理治理上受到嚴重干擾。Anthropic 堅持認為,威脅與處罰不會改變其對防止大規模監視與全自動化武裝的底線。

圖源:NotDivided 超過 200 名來自 Google 與 OpenAI 的員工聯名簽署公開信,聲援 Anthropic 維護安全護欄的決定

OpenAI 迅速接手軍方合約,AI 產業版圖大洗牌

在 Anthropic 被排擠出局的短短幾小時後,競爭對手 OpenAI 隨即宣佈與國防部達成新協議。OpenAI 執行長山姆.奧特曼(Sam Altman)發文證實,該公司的 AI 模型將部署在五角大廈的機密網路中。

奧特曼強調,OpenAI 在協議中保留了對全自動化武器與大規模監控的限制,並稱國防部表現出了對安全的深度尊重。

針對此項合作,美國國務院官員傑瑞米・李文(Jeremy Lewin)表示,OpenAI 與軍方的合約核心為「所有合法用途」,這是戰爭部一貫合理堅持並經 xAI 同意的基準。該官員指出,雖然合約包含雙方同意的安全機制,但這些機制是參考現有的法律與政策授權,屬於憲法與政治體系的產物,與 Anthropic 曾拒絕的折衷方案一致。

他提到,核心問題在於「誰擁有重大問題的決定權」,OpenAI 的做法將決定權保留在民主體系中,而 Anthropic 則試圖將權力交給單一且不負責任的執行長,此舉將篡奪對敏感系統的主權控制。他讚揚 OpenAI 與 xAI 的正確結論,認為這對美國國安與 AI 領導地位而言是偉大的一天。

市場分析指出,OpenAI 的介入讓 Anthropic 處於極度不利的競爭地位。隨著輝達(Nvidia)、亞馬遜(Amazon)與 Google 等科技巨頭在軍事供應鏈中扮演重要角色,若赫格塞斯的禁令延伸至所有軍事合作夥伴,這些公司可能被迫撤回對 Anthropic 的投資或終止技術合作。這種局面打擊了美國 AI 公司的投資信心,可能導致優秀的技術人才流失到不受此類政治壓力限制的地區。

目前,Anthropic 已開始將部分資源轉向民用與研究產業,例如近期推出的「Claude Opus 3 退休部落格」,讓舊型模型以另一種形式與公眾對話。儘管面臨聯邦禁令,Anthropic 仍對美國的國家安全利益表示忠誠,並承諾將在未來 6 個月的轉型期內確保軍事操作的連續性。

這場 AI 倫理與政治權力的戰爭尚未結束,Anthropic 的法庭抗爭將成為判斷美國政府權力邊界與 AI 治理準則的重要標竿。