OpenAI 声称在五角大楼交易中的安全“红线”——但用户并不买账

简要概述

- OpenAI 与五角大楼签署协议,在机密环境中部署人工智能。

- 公司表示设定了“红线”,但合同允许“所有合法用途”,这一标准最终取决于政府的解释。

- 这一争议引发了QuitGPT运动,并推动Claude下载量激增。

OpenAI 本周末表示,已与五角大楼达成协议,在机密环境中部署先进的人工智能系统,标志着公司与美国军方合作的重大扩展。 该公告发布不到24小时,特朗普政府将对手AI公司Anthropic列入“供应链风险名单”,指责其合同条款涉及监控和自主武器的争议。 特朗普还指示联邦机构立即停止使用Anthropic的技术,财政部长Scott Bessent在X上写道,"我们部门正在终止所有对Anthropic产品的使用,包括其Claude平台。"

“美国永远不会允许一个激进左派、觉醒的公司来左右我们伟大军队的作战和胜利!这个决定属于你们的总司令和我任命的伟大领导者。

Anthropic的左翼疯子…… pic.twitter.com/aIEx92nnyx

— 白宫 (@WhiteHouse) 2026年2月27日

此次AI公告的时机使OpenAI的协议受到高度关注。在一篇详细的博客中,公司阐述了其所谓的“红线”和对五角大楼合作的多层安全措施。 OpenAI所描述的协议引发了关于AI系统在国家安全环境中如何管理的更广泛问题,以及公司声明的限制将如何被实际解读和执行。

“合法”并不总够用

OpenAI的博客文章以三项不可谈判的承诺开头:不将其技术用于大规模国内监控,不自主指挥自主武器系统,以及不用于高风险自动决策(如社会信用评分)。

随后是合同中的具体措辞——OpenAI特别称之为“相关措辞”,而非“完整协议”。

“战争部可以在符合法律、操作需求和成熟安全监管协议的情况下,将AI系统用于所有合法目的,”OpenAI表示。 这正是Anthropic在谈判中一直要求的措辞。Anthropic拒绝接受的正是这句话。OpenAI签署了,但仍声称其红线完全未被突破。 然而,在国家安全背景下,“合法”并非固定界限——它存在于一系列法规、行政命令、内部指令以及常常是机密的法律解释中。当合同赋予“所有合法用途”时,实际限制取决于政府当前的法律范围,而非供应商自行设定的标准。

一组条款

武器条款规定,AI“不得在法律、法规或部门政策要求人为控制的情况下,独立指挥自主武器”。

该禁令仅在已有其他权威要求人为控制的情况下适用——其“牙齿”完全借用现有政策,特别是国防部指令3000.09。该指令要求自主系统允许指挥官行使“适当程度的人类判断”以使用武力。

而“适当”是极其主观的。

人类_判断_不同于人类控制。这一区别并非偶然。国防学者指出,故意省略“人-in-the-loop”措辞,旨在保留操作弹性。

OpenAI最强的反驳是其云端部署架构——完全自主的致命决策循环需要在战场设备上进行边缘部署,而这份合同不允许这样做。这是一个真实的技术限制。

但基于云的AI仍能进行目标识别、行为模式分析和任务规划。这些都是杀伤链活动,无论最终触发器在哪个服务器上运行。目标的结果不会因模型运行的服务器不同而改变。

监控条款也遵循类似模式。OpenAI声明的红线是:不进行大规模国内监控。合同措辞为:系统“不得用于不受限制的监控美国人的私人信息,符合这些权限”——然后列出第四修正案、FISA和行政命令12333。

“无限制”一词暗示有限制的监控是允许的。而行政命令12333是NSA用来在境外截获美国人通信的依据。

这也是Anthropic对谈判中措辞的担忧变得明显的地方。Anthropic认为,现行法律尚未跟上AI的可能性。政府可以在没有搜查令的情况下,合法购买大量关于美国人的商业数据——而且已经这么做了。

OpenAI的合同措辞通过将保护措施绑定在现有法律框架上,可能无法弥补Anthropic担心的法律空白。

Altman回应

周六晚上,Altman举行了AMA,回答了数千个关于协议的问题。当被问及什么情况下OpenAI会退出政府合作时,他回答:“如果被要求做一些违宪或非法的事情,我们会退出。”

如果被要求做一些违宪或非法的事情,我们会退出。如有必要,欢迎来我监狱看我。

— Sam Altman (@sama) 2026年3月1日

这一表述将OpenAI的底线定位于合法性——而非公司是否会在某些情况下启用某些行为的伦理判断,后者是Anthropic所强调的。被问及是否担心未来会出现“合法”定义的争议,他承认风险:“如果我们必须面对那场争斗,我们会,但这显然会带来一些风险。”

关于为何OpenAI达成了Anthropic无法接受的协议,Altman表示:“Anthropic似乎更关注合同中的具体禁止条款,而非适用法律,我们对此感到比较放心。我当然更倾向于依靠技术保障,如果只能选择一种。我认为Anthropic可能希望拥有比我们更多的操作控制。”

这是一个实质性的哲学分歧。Anthropic认为,由于前沿模型可以以难以预料的方式被重新用于情报和军事工作,限制必须明确且具有约束力,即使会影响合作。OpenAI的立场是,技术架构、嵌入人员和现有法律共同构成比合同文本更强的保障。

公众站队

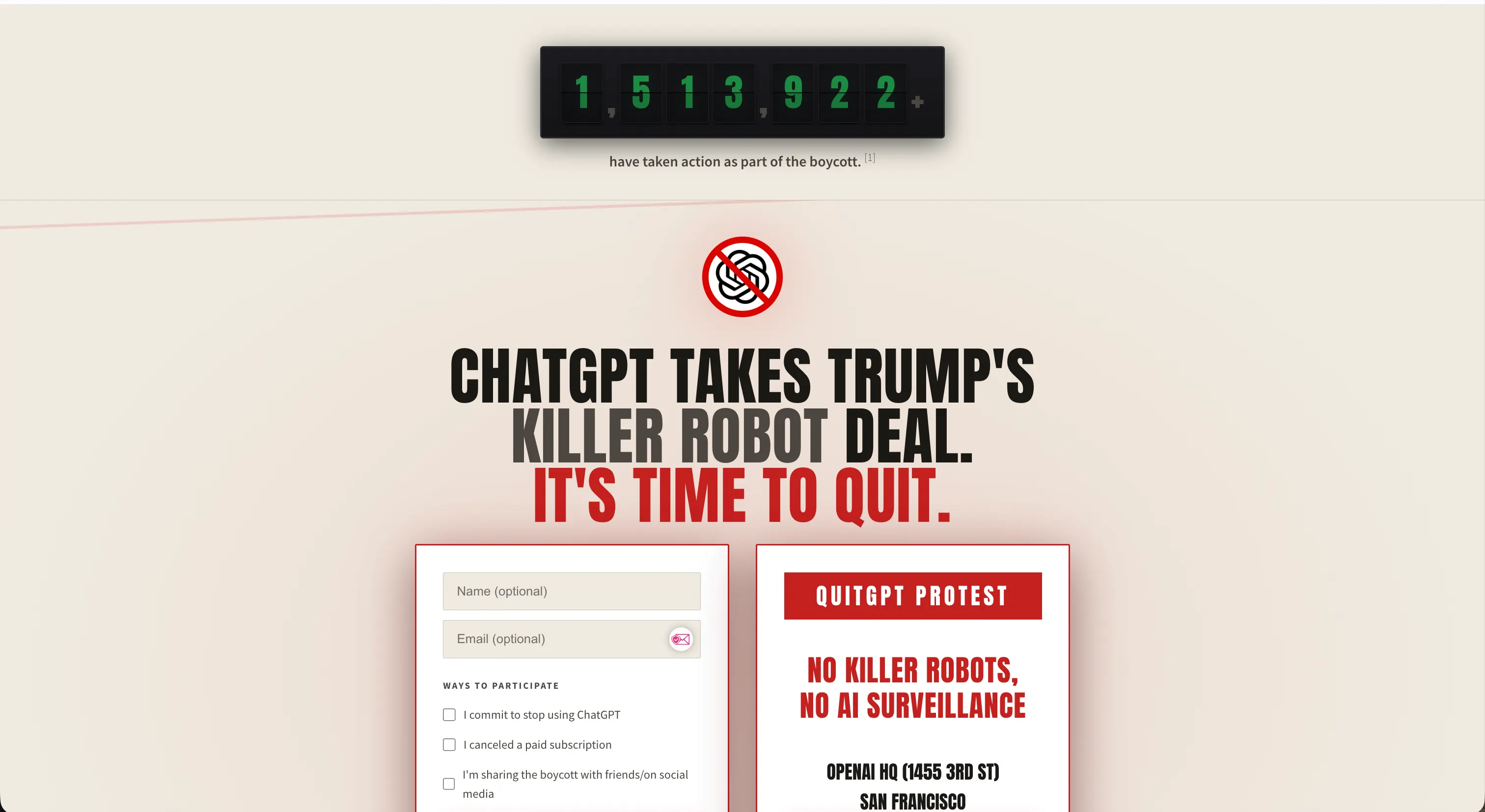

反弹立即出现。到周一,“QuitGPT”运动声称已有超过150万人采取行动——取消订阅、分享抵制帖或在quitgpt.org注册。

该运动将OpenAI的举动描述为优先考虑军事合同而非用户安全,指责公司同意让五角大楼将其技术用于“任何合法目的,包括杀人机器人和大规模监控”。

OpenAI可能会反驳这种说法,但市场已然行动。

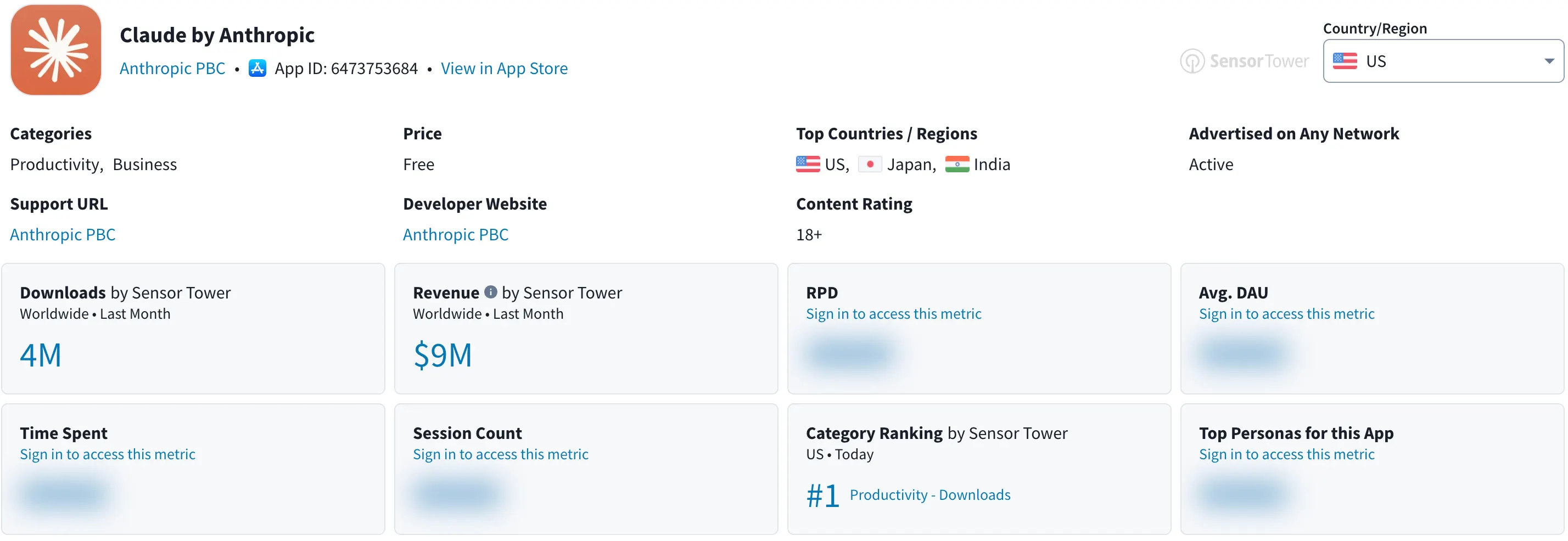

Anthropic的Claude在苹果App Store中超越ChatGPT,成为美国最下载的免费应用,_Decrypt_告诉记者,周末每日注册数创纪录。

流行歌手Katy Perry在X上分享了Claude的定价页面截图。数百用户在Reddit上公开取消订阅。有人在旧金山办公室外涂鸦赞美Anthropic,粉笔攻击覆盖了OpenAI的街道。甚至有数百名OpenAI员工曾签署公开信,支持Anthropic拒绝满足五角大楼的要求。

QuitGPT的说法情感上引人共鸣,但并不完全准确。Anthropic本身与Palantir和亚马逊云服务合作,向美国情报机构和国防部门提供Claude模型,且据称已在军事行动中被用来推翻委内瑞拉和伊朗的政府。AI伦理和国家安全合同的关系从未纯粹。

运动所捕捉到的,准确地说,是大量用户相信两家公司在界限设定上存在明显差异——并通过订阅投票表达了态度。

这种差异是否如表面看起来那样重要,需仔细阅读合同才能判断。