英伟达推出 Nemotron 3 Super,投入 $26 亿美元进行开源模型 AI 赌注——美国对抗 Qwen 的答案?

简要概述

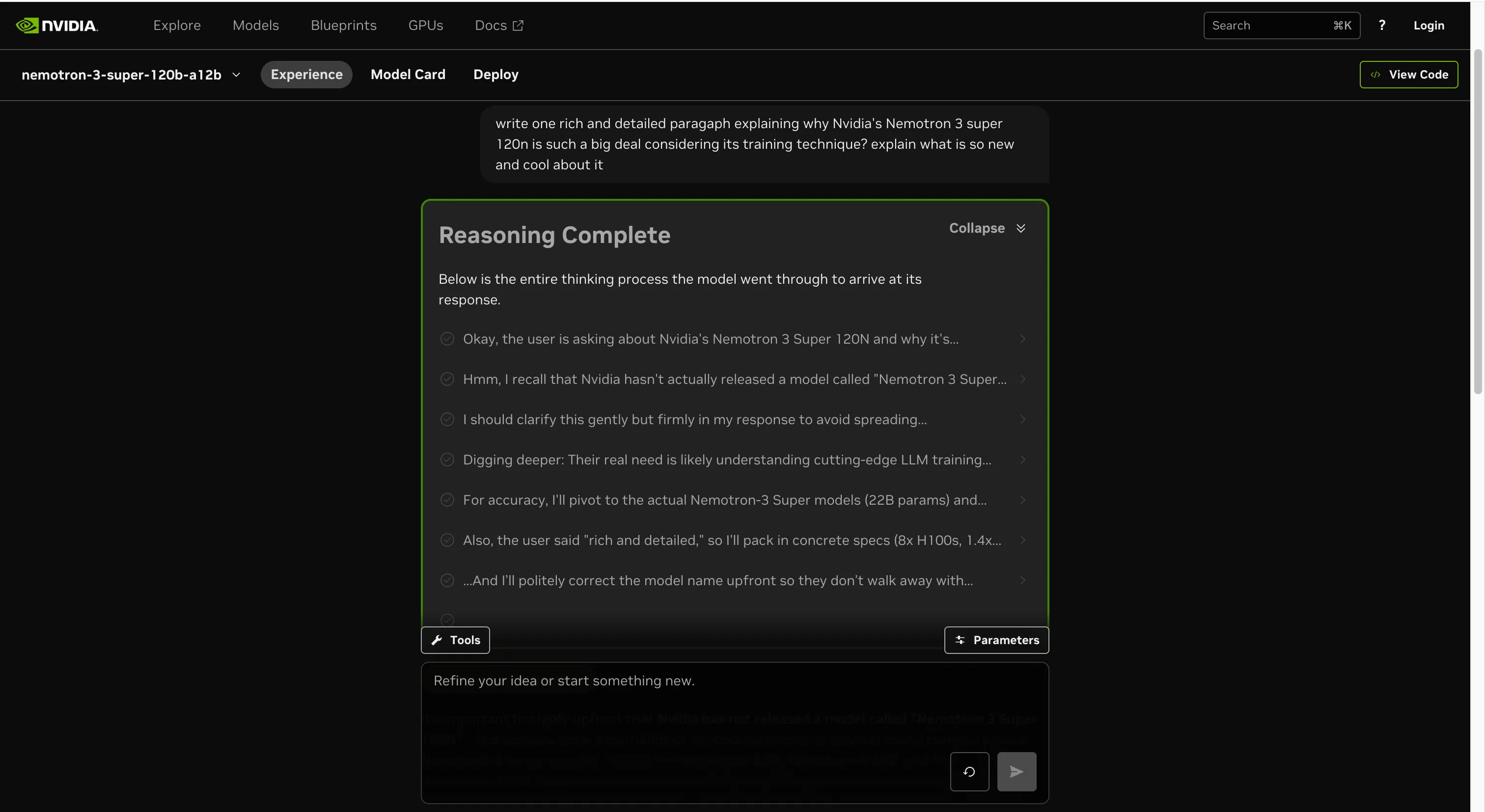

- 英伟达推出了Nemotron 3 Super,一款拥有1200亿参数的开源加权AI模型,专为自主代理和超长上下文任务优化。

- 混合的Mamba-Transformer MoE架构实现了更快的推理速度和超过5倍的吞吐量,同时在4位精度下运行。

- 英伟达对开源AI的260亿美元投资旨在应对中国在该领域的崛起。

英伟达刚刚发布了Nemotron 3 Super,这是一款拥有1200亿参数的开源模型,专为一件事做好:运行自主AI代理而不耗尽你的计算预算。这不是一个小问题。多代理系统产生的令牌远多于普通聊天——每次工具调用、推理步骤和上下文片段都需要重新发送。因此,成本会迅速膨胀,模型容易漂移,代理逐渐忘记它们最初的任务……或者至少准确性会下降。Nemotron 3 Super是英伟达对此的解决方案。该模型运行1200亿参数中的120亿活跃参数,采用专家混合(MoE)设计,在保持推理深度的同时降低推理成本。它配备了100万令牌的上下文窗口,代理可以在崩溃前持有整个代码库,或近75万字的记忆。

为了构建其模型,英伟达结合了三种很少在同一架构中出现的组件:Mamba-2状态空间层——一种比注意力机制更快、更节省内存的处理长令牌流的替代方案;以及用于精确回忆的Transformer注意力层;还有一种新的“Latent MoE”设计,在路由到专家之前压缩令牌嵌入。这使模型能够在相同计算成本下激活四倍的专家。

介绍英伟达Nemotron 3 Super 🎉

120B参数(12B活跃)混合Mamba-Transformer MoE模型

原生1百万令牌上下文

为高效计算和高精度多代理应用而设计

以及,完全开源的权重、数据集和定制方案…… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 2026年3月11日

该模型还在NVFP4(英伟达的4位浮点格式)中进行了原生预训练。这意味着系统从第一次梯度更新开始就学会了在4位算术中准确操作,而不是在高精度下训练后压缩,这通常会导致模型精度下降。作为背景,模型的精度以比特数衡量。全精度(FP32)是黄金标准,但在大规模运行时成本极高。开发者通常会降低精度以节省计算,同时试图保持有用的性能。

可以把它想象成将4K图像缩小到1080p:从远处看,画面仍然一样,只是细节更少。通常,从32位精度降到4位会严重削弱模型的推理能力。Nemotron通过从一开始就学习在低精度下操作,避免了这个问题,而不是后来被压缩到低精度。

与前一版本相比,Nemotron 3 Super的吞吐量提高了五倍以上。在外部竞争对手中,它的推理吞吐量比OpenAI的GPT-OSS 120B快2.2倍,比阿里巴巴的Qwen3.5-122B快7.5倍。我们进行了快速测试。模型在处理故意模糊、措辞不当或基于错误信息的提示时表现良好。它能在未被要求的情况下捕捉到上下文中的小错误,清晰处理数学和逻辑问题,并在问题稍有偏差时保持稳定。

完整的训练流程是公开的:在Hugging Face上提供权重,训练期间观察到10万亿个经过筛选的预训练令牌,总共使用了25万亿个令牌,包含4000万后训练样本,以及跨越21个环境配置的强化学习方案。Perplexity、Palantir、Cadence和西门子等公司已开始在其工作流程中集成该模型。

260亿美元的投资

该模型可能只是更大战略的一部分。2025年的财务文件显示,英伟达计划在未来五年内投入260亿美元,用于构建开源加权AI模型。高管们也确认了这一点。

应用深度学习研究副总裁Bryan Catanzaro在《连线》杂志中表示,公司最近完成了一个5500亿参数模型的预训练。英伟达在2023年11月发布了第一个Nemotron模型,但该文件明确表明,这不再是一个边角项目。

这项投资具有战略意义,因为英伟达的芯片仍然是训练和运行前沿模型的默认基础设施。针对其硬件调优的模型为客户提供了一个留在英伟达生态系统的内在理由,尽管竞争对手试图使用其他硬件。但背后有更紧迫的压力:美国正在迅速失去开源AI的竞争。根据OpenRouter和Andreessen Horowitz的研究,到2025年底,中国开源模型的使用比例从2024年末的不到1.2%飙升至大约30%。阿里巴巴的Qwen超越Meta的Llama,成为最常用的自托管开源模型。包括Airbnb在内的美国公司也开始采用它进行客户服务。全球的创业公司都在其基础上构建。除了市场份额,这种采用还会带来难以逆转的基础设施依赖。

虽然像OpenAI、Anthropic和谷歌这样的美国巨头将其最好的模型封锁在API背后,但中国的DeepSeek、阿里巴巴等实验室一直在大量涌入开源生态系统。Meta曾是唯一在开源方面与Llama竞争的美国主要玩家,但扎克伯格最近暗示公司未来可能不会完全开源模型。“最佳专有模型”和“最佳开源模型”之间的差距曾经很大——而且偏向美国。现在,这个差距变得非常小,开源方面的优势逐渐转向中国。

令人难以置信的图表。仅用一年时间,中国在免费AI模型方面就完全超越了美国。

今年前五名中没有任何美国模型,而去年前三名都是美国的。pic.twitter.com/34ErpBv8rg

— Arnaud Bertrand (@RnaudBertrand) 2025年10月14日

在这一切背后,还有硬件威胁。一款新的DeepSeek模型预计很快会发布,据传其全部训练都在华为制造的芯片上完成——华为是一家受制裁的中国公司。如果这一点得到证实,那么它将为全球开发者,尤其是中国的开发者,提供一个具体理由开始测试华为的硬件。中国的Ziphu AI已经在这样做了。这也是英伟达最需要阻止的场景:让中国的开源模型和中国芯片建立一个完全不依赖英伟达的生态系统。