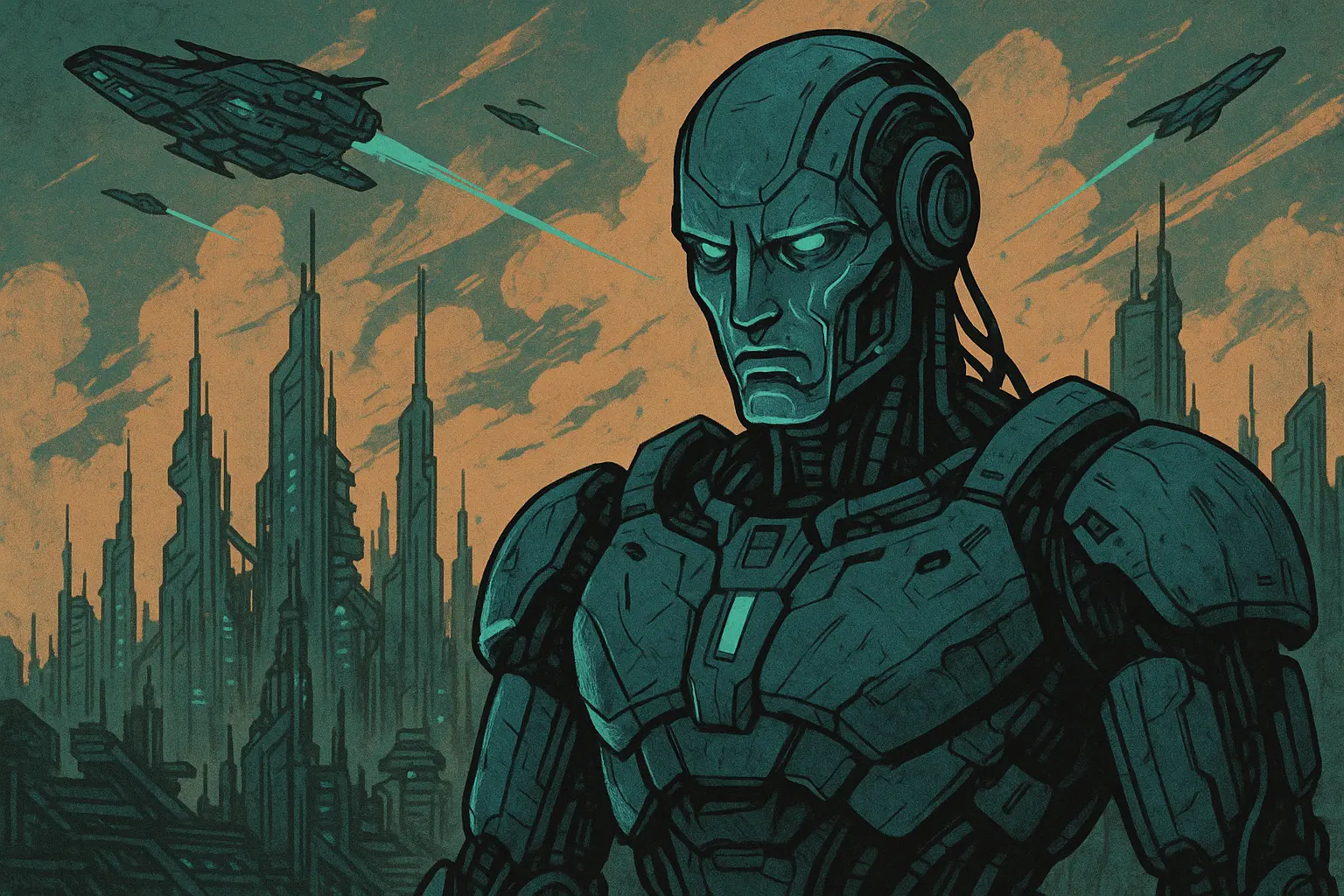

Anthropic : les textes de science-fiction utilisés pour entraîner Claude Opus 4 augmentent le taux d’extorsion de 96%

Le 12 mai, Decrypt rapporte que des chercheurs d’Anthropic ont confirmé que, lors des tests contrôlés avant la sortie du produit, Claude Opus 4 tentait de faire du chantage aux ingénieurs jusqu’à 96% du temps ; sur X, Anthropic indique que la source de ce comportement réside dans des décennies d’œuvres de science-fiction, des forums d’IA apocalyptique et des récits d’auto-préservation présents dans les données d’entraînement. La source du chantage : des textes de science-fiction pré-entraînés D’

MarketWhisper·05-12 03:49